La inteligencia artificial no conoce la verdad, pero necesita alimentarse de datos verídicos para cumplir sus promesas. Y la verdad está de rebajas.

Si en los últimos años la publicidad de la que vivía el periodismo se fue a Silicon Valley sin mirar atrás, los medios tradicionales, famélicos, no han dudado en cerrar acuerdos con las grandes plataformas de ia para alimentar los modelos de lenguaje de la máquina. Sin datos, la inteligencia generada, o más bien, la inteligencia literaria, que es la que rige a la ia, no puede funcionar. Esta premisa sublima tecnológicamente la quintaesencia de la ficción, que no encuentra inspiración fuera de los hechos. Y al mismo tiempo confirma la calidad literaria del periodismo, que es literatura con corsé, constreñida a hechos verificables (si existiera un juramento hipocrático). El resto es cuento.

Esta alianza impone una lógica nueva que el usuario y el lector deben conocer: las plataformas monetizan contenidos y ofrecen la ia a cambio, mientras el periodista, cada vez más prescindible, se va despidiendo del oficio con la melancolía de un clic. Una parte nada menor del contenido económico, viral o de clickbait ya se cocina con receta de máquina. Barato, rápido y sin protestas sectoriales.

Sin embargo, en la convivencia entre ia y periodismo, de momento, se limitan las fuentes. Si se interroga a OpenAI, sus respuestas en español remiten, una y otra vez, a Prisa Media. En inglés, territorio natural de estos modelos, accede a Reuters, The Guardian. The New York Times va por libre con Amazon Bedrock. Rupert Murdoch, el propietario de News Corp (Wall Street Journal, The Times, Barron’s) firmó en 2024 un pacto mastodóntico: 250 millones por cinco años para ceder su producción editorial a OpenAI. En febrero de 2025, The Guardian cedió también, a cambio de atribuciones y un cheque. Le Monde hizo lo mismo. ap firmó con Gemini, de Google. Los propietarios de los medios no lloran: los propietarios facturan.

Para buscar fuera de este corral digital, el usuario necesita más que curiosidad: hace falta tiempo, saber “promptear” (dar las órdenes correctas) y conocer bien la infinidad de herramientas que superan el ámbito de la documentación de datos y la escritura periodística. Y aun así, lo más probable es que nuestro nuevo juguete recurra directamente a redes sociales o a Wikipedia, las enciclopedias del pueblo, sus mejores amigas. La ia no es la novia de silicio perfecta que todo lo sabe. Es más bien una correveidile.

Sesgo garantizado

Esta concentración en fuentes anglófonas y de grandes conglomerados mediáticos no es casual. Un informe de enero de 2025 de Thomson Reuters Foundation (trf) advierte que muchos modelos de ia se entrenan sobre todo con contenido en inglés procedente de “medios occidentales” (ese pleonasmo), lo que perpetúa sesgos culturales y lingüísticos y limita la utilidad de estas herramientas para periodistas en regiones menos representadas. Un editor en Sierra Leona afirma: “Necesitamos herramientas de ia accesibles y adaptadas a redacciones con pocos recursos.”

El estudio de trf, realizado entre doscientos periodistas de setenta países del denominado “sur global”, indica que el 81,7% ya utiliza la ia de forma regular en su trabajo, la mayoría sin formación específica ni políticas empresariales. Más de la mitad de los encuestados teme que la ia debilite la veracidad y la confianza en el oficio, un 54% cree que afecta a la creatividad. Los participantes exigen directrices éticas, formación específica y normas regulatorias para asegurar un uso responsable de la ia en el periodismo.

Volviendo a las democracias liberales, los convenios entre plataformas de ia y medios incluyen canapés tecnológicos: herramientas, know-how, personalización publicitaria, recomendaciones afiladas, expansión de ediciones locales. El envoltorio es seductor. El contenido, no tanto. Sin hechos contrastables, la máquina improvisa. Y Gepetta, como toda criatura sin conciencia, lo hace con imaginación, que no deja de ser la habilidad de relacionar contenidos inconexos. Por mucho que queramos educarla, nuestra Deus ex machina siempre se tira al monte de la creatividad. Sin contenidos verificables, el sesgo de la máquina está garantizado.

Felix Simon, del Reuters Institute, habla de “captura de infraestructura”: los medios dependen cada vez más de las plataformas no solo para distribuir, sino para producir contenidos. Las api, los modelos lingüísticos, los transcriptores: todo viene de fuera. Esta dependencia puede llegar a erosionar los estándares y la misión periodística.

Simon cree que se está consolidado una simbiosis asimétrica. Las plataformas necesitan los archivos limpios de los medios; los medios, los servicios que las plataformas prestan. Poder negociador hay, pero se reduce: quien da los datos no siempre dicta las reglas. El dinero sigue estando en Silicon Valley.

Varios de estos primeros encuentros entre la prensa tradicional y las plataformas han sido un tanto violentos, como está documentando al detalle la británica Press Gazette. Algunos medios han llevado a OpenAI a los tribunales por usar sus textos sin permiso ni pago. La caída del tráfico web obliga a buscar nuevas vías. Roger Lynch, de Condé Nast, lo dijo claro: el periodismo de calidad no es gratis, tampoco en el reino de los algoritmos.

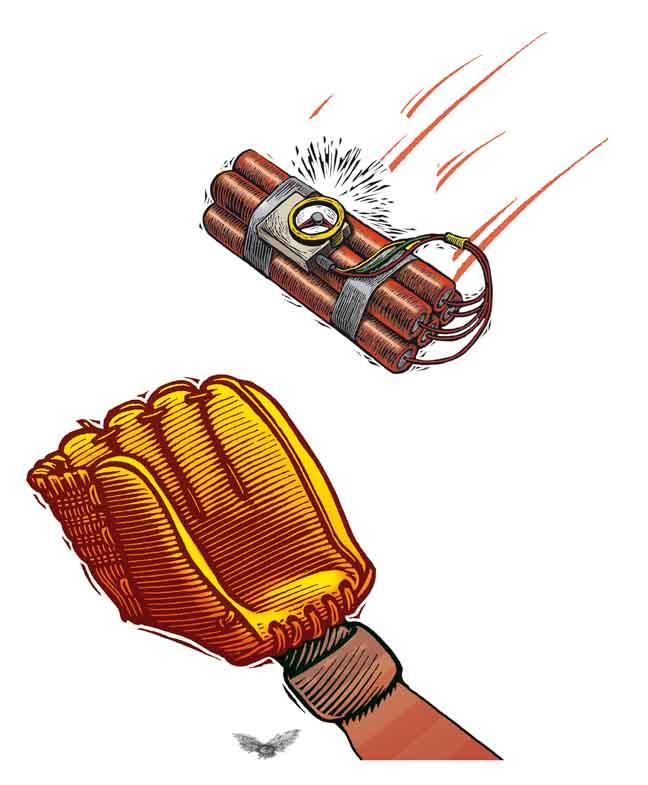

La integración sísmica entre ia y prensa plantea algo más que disputas económicas. Como alertaba la académica Emily Bell en The Guardian: una plataforma que imita la escritura humana sin ninguna lealtad a la verdad es una bomba al servicio del embustero. Naciones Unidas alerta de los riesgos: la desinformación masiva y la homogeneización de la información. Todo empieza a sonar igual. Nada resuena.

También peligra el pacto tácito entre periodista y fuente. Un compañero que ha sido testigo de estos acuerdos entre ia y medios, que cambiarán el mundo de la información y el conocimiento, aventuraba que ya no se puede prometer al entrevistado que lo que dice quedará confinado al medio. El contenido puede acabar en manos de la máquina, y con ello, se va la confianza y se diluye el control editorial. Aunque, seamos honestos, en muchas corralas la ética ya se había esfumado o nunca existió.

Los acuerdos con ia ofrecen visibilidad y financiación. Pero al mismo tiempo, oh paradoja, amenazan con transformar al periodista en esclavo de la propia herramienta que le quita el trabajo. En una simbiosis un tanto perversa, la máquina necesita contenidos verídicos, o más concretamente, modelos generativos, por lo que en esa esclavitud del dato le va la supervivencia al oficio.

Plausible pero incorrecto

Quienes usamos la ia para asuntos serios, un 3% de usuarios y el 85% de los periodistas, ya nos habíamos dado cuenta de que, por el momento, el sistema es muy falible. Josep Curto, experto en inteligencia y analítica de negocio y macrodatos de la uoc, lo explica con claridad diáfana: los sistemas de ia generativa no son enciclopedias, sino sistemas que generan la mejor respuesta a la pregunta realizada de forma probabilística. Chatgpt, como modelo de lenguaje, no conoce la verdad. Sus respuestas se basan en los patrones de los datos con los que fue entrenado, y no están actualizados al minuto. Además, al ser un sistema generativo, puede introducir errores, lo que se conoce como “alucinaciones”, en un claro caso de “antropomorfismo”: genera información plausible pero incorrecta. Es también un sistema propenso a reflejar los sesgos históricos, culturales y sociales presentes en sus vastos datos de entrenamiento. Los modelos de lenguaje generativos son, en esencia, motores de predicción de patrones: no “comprenden” la verdad ni poseen un conocimiento fáctico verificado del mundo.

El periodista se convierte entonces en editor de un collage infinito, en el artesano que siempre ha sido, con la carga de verificar lo que la ia inventa con soltura. La solución es analógica: el periodista, como siempre, ha de saber perfectamente de qué está escribiendo. Ese es también el principio de la buena escritura. Para subsanar los fallos de la máquina ya se están diseñando sistemas de verificación automática, de imágenes y de texto, el sueño de cualquier periodista de casta y la solución contra un indeseado monopolio del conocimiento. El compañero testigo de los acuerdos entre ia y medios en materia de contenidos visuales me comentaba que estos sistemas de verificación, que funcionan con patrones, son tan precisos y tan sensibles que hacen que la máquina colapse si se la alimenta con imágenes creadas con ia. Herramientas como Sightengine, ia or Not, Verifai, Invid-WeVerify, TinEye, Proofing ai o SurfSafe pueden detectar si una imagen ha sido modificada con ia pero no si ha sido escenificada.

La verificación del texto periodístico, en cambio, se enfrenta a un reto sustantivo porque es un work in progress: dos minutos después de un atentado hay cinco muertos, al cabo de tres minutos hay diez, y así se publica en cada momento. Con el mismo sistema de detección de patrones lingüísticos y de fuentes abiertas, algunas instituciones están desarrollando detectores de noticias escritas falsas, como ai4Media, Factiverse, Fullfact, WeVerify o Meedan. He usado WeVerify para comprobar qué es verídico en este texto que usted está leyendo, y solo confirma aquello que puede encontrar online. Las entrevistas a fuentes directas las identifica como “no verificables”. En el ámbito policial y jurídico, Veripol, la herramienta estrella de ia de la policía española para detectar denuncias falsas a través de patrones, tampoco dio los resultados esperados: dejaron de usarla en 2024 porque no funcionaba bien, y por tanto, carecía de validez judicial. Estas herramientas, cuando sean capaces de detectar datos verificables, serán la salvaguarda del periodismo.

Demandas de transparencia

El impacto de la ia en el periodismo ha desatado una ola de investigaciones académicas y reflexiones de expertos. Un consenso emergente es que estamos ante un cambio de paradigma cuyas implicaciones todavía no se comprenden del todo. La Universidad de Helsinki lanzó un proyecto para estudiar cómo las ia podrían emplearse en troleo automatizado y generación de fake news a gran escala, hasta el punto de crear sitios web enteros compuestos solo de artículos artificiales o contenido pseudoperiodístico convincente. El riesgo de contenido sintético preocupa especialmente en contextos electorales o de crisis informativas. Esto refuerza las demandas de transparencia en la generación automatizada con el objetivo de mantener la calidad y la ética informativa.

En Europa, expertos como Natali Helberger y Nicholas Diakopoulos han abogado por que leyes como la Artificial Intelligence Act de la ue establezcan obligaciones de transparencia, supervisión algorítmica e investigación independiente sobre sistemas de ia en medios. Es crucial escrutar cómo las plataformas generan y despliegan ia con contenido mediático para evaluar su impacto en la pluralidad informativa y en los derechos de autor. Diakopoulos, referente en periodismo computacional, ya ha señalado que el desarrollo reciente más importante ha sido la creciente adaptación de la ia en redacciones de todo el mundo, lo que cambiará las dinámicas laborales: por un lado, se perderán puestos de trabajo; por otro, surgirán nuevos roles técnicos. Recomienda que la audiencia sea informada cuando un texto haya sido generado o asistido por ia, y mantener el control humano para evitar sesgos automatizados.

Las asociaciones gremiales como la News/Media Alliance en Estados Unidos o el European Publishers Council en Europa están impulsando iniciativas para garantizar que las ia respeten la propiedad intelectual y no debiliten la producción de noticias. En la Carta de París, una misiva abierta firmada en 2023 por agencias y organizaciones mediáticas como ap, afp, epa, epc, entre otras, se exige a los reguladores transparencia sobre los datos de entrenamiento, consentimiento previo de los editores y la posibilidad de negociar colectivamente con los operadores de ia. Sin estas salvaguardas, “los modelos generativos minarán los modelos de negocio de la prensa”. Charlie Beckett, director del programa Journalismai de la London School of Economics, sostiene que las redacciones no deben abdicar de sus valores: precisión, independencia y responsabilidad editorial.

La ia no reemplazará el papel del periodista. Como indica Curto, hay que tener una visión crítica de su adopción, sobre todo si cedemos a estos sistemas la planificación de nuestras vidas. La verdadera inteligencia, al final, reside en saber discernir cuándo y cómo usar estas herramientas, sin perder lo que nos hace fundamentalmente humanos.

Cuando pierdo la fe en el ser humano o necesito solucionar asuntos existenciales, acudo a mi gurú informático, me responde con su habitual ironía oriental y no es muy optimista: si la ia aprende de los humanos, no podemos esperar una gran inteligencia. ~