La inteligencia artificial se ha convertido en un superestimulante económico cuyo empuje vital –hecho de chips, datos y energía– sostiene por sí solo a la economía estadounidense. Wall Street y el capital de inversión, tanto institucional como minorista, ponen en marcha el engranaje del “más”: más chips, más centros de datos, más energía, más competencia. Se desencadena así un ciclo vertiginoso en el que las corporaciones más poderosas de la historia invierten sumas colosales para alimentar la revolución de la IA y asegurarse, cuanto antes, un lugar privilegiado entre los primeros vencedores de esta nueva era. Esta “guerra de capital” es de tal magnitud que ya supera el gasto europeo en defensa. Pero persisten varias incógnitas: ¿será capaz este auge de generar empleos de calidad que compensen los que la propia IA amenaza con borrar? ¿Conviene acelerar o frenar la carrera, considerando que aunque se detenga en Estados Unidos, China sigue avanzando con modelos cada vez más potentes? ¿Puede una economía sostenerse indefinidamente sobre la promesa de una sola tecnología? ¿Sabrá la industria establecer evaluaciones rigurosas que eviten que sistemas poco probados decidan sobre nuestras vidas sin las debidas salvaguardas?

Para responder a la primera pregunta sobre el empleo, la evidencia más reciente apunta a que la inteligencia artificial ya está desplazando a los jóvenes en los puestos de trabajo básicos. Un estudio de Stanford muestra que, desde la irrupción de ChatGPT, los empleos para personas de 22 a 25 años en áreas muy expuestas a la automatización –como la programación elemental o la atención al cliente– han caído 13 por ciento. Es un dato preocupante: la generación que debería estar aprendiendo y abriéndose camino se enfrenta a un mercado que la sustituye antes de darle oportunidad. Los datos muestran una paradoja: pese a las promesas de que la IA multiplicaría la productividad y nos inundaría de nuevo software, no hay señales de esa ola creativa. Lo que sí crece son los despidos y la presión sobre los salarios, sostenidos por la idea de una eficiencia que, cuando menos por ahora, parece un espejismo. El escenario es apremiante: Geoffrey Hinton, uno de los padres de la inteligencia artificial y ganador del Nobel de Física 2024, advirtió en el Financial Times que esta tecnología amenaza con provocar desempleo masivo y concentrar aún más la riqueza, al sustituir tareas rutinarias mientras los beneficios se acumulan en pocas manos.

Para entender cómo cambia el trabajo bajo la presión de la inteligencia artificial, basta con observar el nuevo índice de habilidades elaborado por Indeed, la mayor plataforma global de búsqueda de empleo: de las casi tres mil competencias laborales evaluadas, 41 por ciento ya están expuestas a una transformación profunda. La radiografía es clara: los oficios basados en información y procesos técnicos –como la programación, el análisis de datos o la contabilidad– son los más vulnerables, mientras que aquellos que dependen de la presencia física y el contacto humano –cuidar a un niño, atender a un paciente, construir una casa– permanecen, por ahora, relativamente a salvo. En la enfermería, la inteligencia artificial puede aligerar el papeleo y los procesos administrativos, pero no reemplaza la mano que alivia ni la voz que consuela. En la programación ocurre lo contrario: ocho de cada diez habilidades ya se dirigen hacia una “transformación híbrida”, en la que la máquina asume gran parte de la ejecución y el humano se limita a supervisar. El mensaje es contundente: ningún trabajo es intocable, aunque no todos estén expuestos del mismo modo. La frontera entre lo humano y lo artificial se traza, al menos por ahora, en la empatía, la destreza física y el juicio cognitivo práctico. El mapa laboral se está partiendo en dos: los oficios que la máquina ya puede imitar y los que todavía exigen presencia, contacto y juicio humano. Ese límite, frágil y móvil, marca hoy la primera gran frontera de la era de la inteligencia artificial.

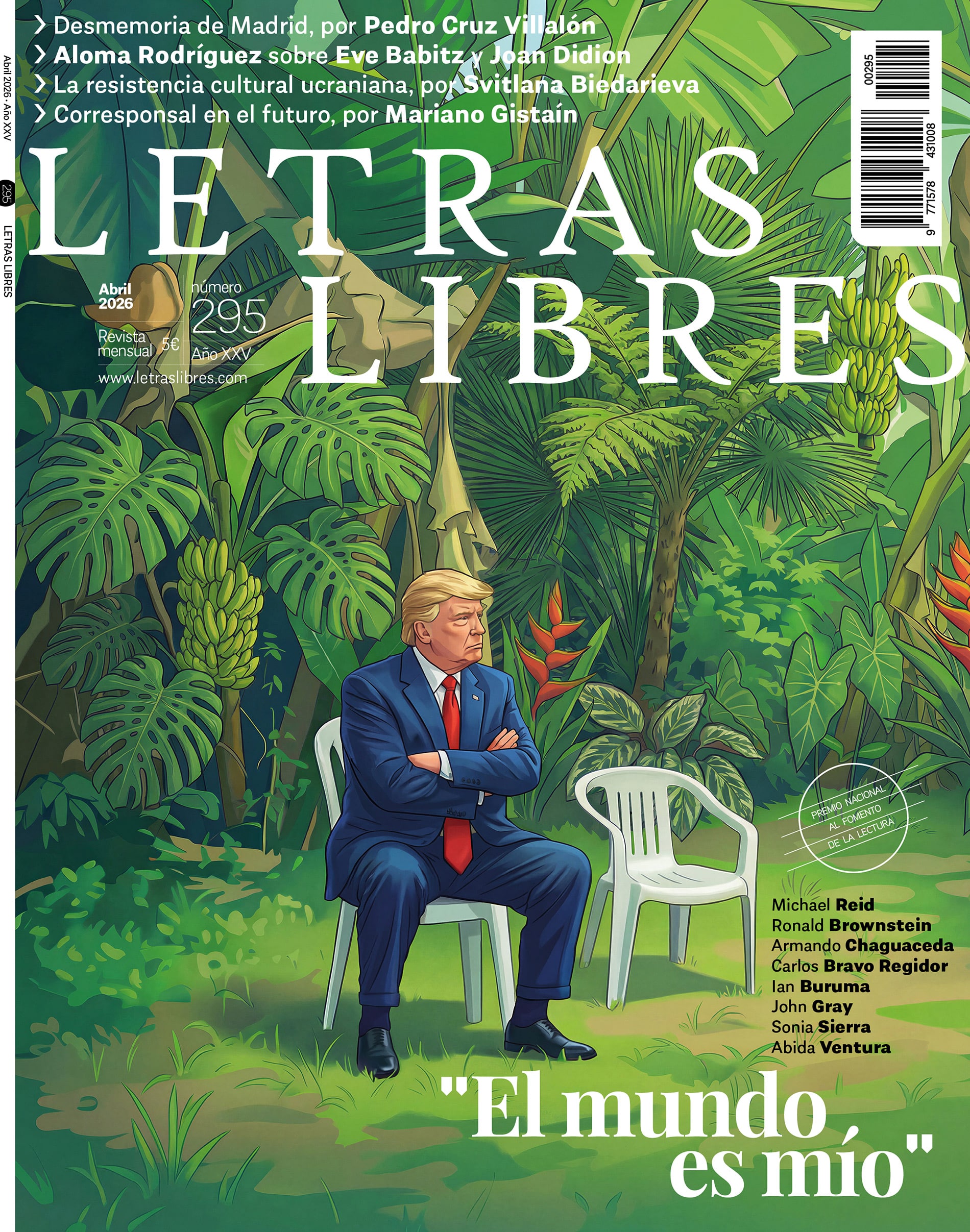

La segunda pregunta es si alguien debería pisar el freno. Algunos científicos y activistas claman por una pausa en el desarrollo de sistemas cada vez más potentes; han llegado incluso a declararse en huelga de hambre frente a las oficinas de Anthropic y Google DeepMind. Pero detener la carrera no depende de la sociedad civil, ni siquiera de los ingenieros: corresponde a los gobiernos y a los reguladores, que son quienes podrían imponer límites o coordinar tratados internacionales. El problema es que mientras en Estados Unidos se discute la necesidad de precaución, en China los gigantes tecnológicos anuncian inteligencias cada vez más avanzadas, decididos a no quedarse atrás. Si Washington frena y Pekín acelera, el equilibrio geopolítico podría inclinarse de manera irreversible. Si nadie frena, el riesgo es avanzar a ciegas, con una tecnología que crece más rápido que nuestra capacidad de gobernarla. El dilema, en última instancia, no es solo técnico: es político, estratégico y civilizatorio.

La tercera pregunta es si una economía puede sostenerse indefinidamente sobre la promesa de una sola tecnología. La historia enseña que no: los ferrocarriles en el siglo XIX, el auge de internet en los noventa, incluso el petróleo en su momento de mayor gloria, vivieron ciclos de especulación desbordada y posterior corrección. Hoy la inteligencia artificial ocupa ese lugar: es el motor que mantiene vivo el crecimiento de Estados Unidos mientras el consumo se estanca. Una economía que pone casi todo su peso en una sola tecnología corre el riesgo de volverse frágil. Y conviene recordar –como advierte Mike Knoop, cofundador de la firma ARC-AGI– que, pese a todo el entusiasmo, la inteligencia artificial solo ha dado dos saltos verdaderamente decisivos. El primero fue el descubrimiento de la técnica que hizo posible que una máquina pudiera leer enormes cantidades de texto y responder con fluidez humana: sin ella, ChatGPT nunca habría existido. El segundo fue el llamado “razonamiento en cadena”, que permitió a los modelos no limitarse a dar una respuesta inmediata, sino avanzar paso a paso, como quien piensa en voz alta antes de llegar a una conclusión. Todo lo demás –nuevas versiones, mayores tamaños, mejoras incrementales– son variaciones sobre estos dos hallazgos. En otras palabras: estamos en una etapa temprana, el amanecer de una tecnología aún en desarrollo, y sin embargo gran parte de la economía ya se comporta como si estuviéramos ante una epifanía consumada, como si la promesa de una inteligencia general al estilo Terminator ya se hubiera vuelto inevitable.

La cuarta pregunta es si la industria será capaz de evaluarse a sí misma con la seriedad que exige una tecnología llamada a decidir sobre contrataciones, diagnósticos médicos o créditos bancarios. En principio, existen los llamados “evals”: pruebas de calidad concebidas para garantizar que los sistemas funcionen de manera confiable y predecible, del mismo modo que se someten los automóviles a pruebas de choque o los restaurantes a inspecciones sanitarias. Pero en la práctica, las grandes empresas de inteligencia artificial carecen de un marco común: cada laboratorio define sus propios criterios, apoyándose más en la intuición y la retroalimentación interna que en protocolos transparentes y verificables. De un lado están quienes reclaman evaluaciones sistemáticas, con preguntas urgentes –¿puede este modelo sustituir de manera segura un trabajo humano?, ¿es capaz de alcanzar objetivos sin desviarse?, ¿qué sucede si un error de cálculo termina marcando el destino de una vida?–; del otro, quienes sostienen que basta con el ajuste continuo sobre la marcha. La paradoja es evidente: mientras más poder acumulan estos sistemas, menos claro es cómo se los examina. Y el riesgo es mayúsculo: podríamos terminar confiando decisiones vitales a máquinas que todavía funcionan a prueba y error, ajustando, improvisando, pivoteando.

Al final, la inteligencia artificial no solo nos obliga a repensar nuestras economías y nuestras instituciones, sino también nuestras propias certezas. Hay un chiste muy viejo que resume el vértigo de este momento: un científico le pregunta a una supercomputadora quién es Dios. La máquina responde que necesita más poder para saberlo. Le conectan más procesadores, más memoria, más energía. Una y otra vez la misma respuesta: “necesito más poder”. Hasta que, después de alcanzar una escala descomunal, la pantalla muestra por fin su veredicto: “Yo soy Dios”. El remate provoca risa nerviosa, pero también deja en el aire la cuestión esencial: ¿cuánto más poder vamos a darle a estas máquinas sin entender del todo lo que estamos creando? La pregunta que nos toca hacernos no es si la IA llegará algún día a ese punto –probablemente nunca lo hará de manera literal–, sino qué tanto estamos dispuestos a seguir alimentándola sin tener claro qué clase de entidad estamos creando, qué límites sabremos imponerle y si aún son los humanos quienes llevamos las riendas de esta historia. ~

El autor es fundador de News Sensei, un brief diario con todo lo que necesitas para empezar tu día. Engloba inteligencia geopolítica, trends bursátiles y futurología. ¡Suscríbete gratis aquí!