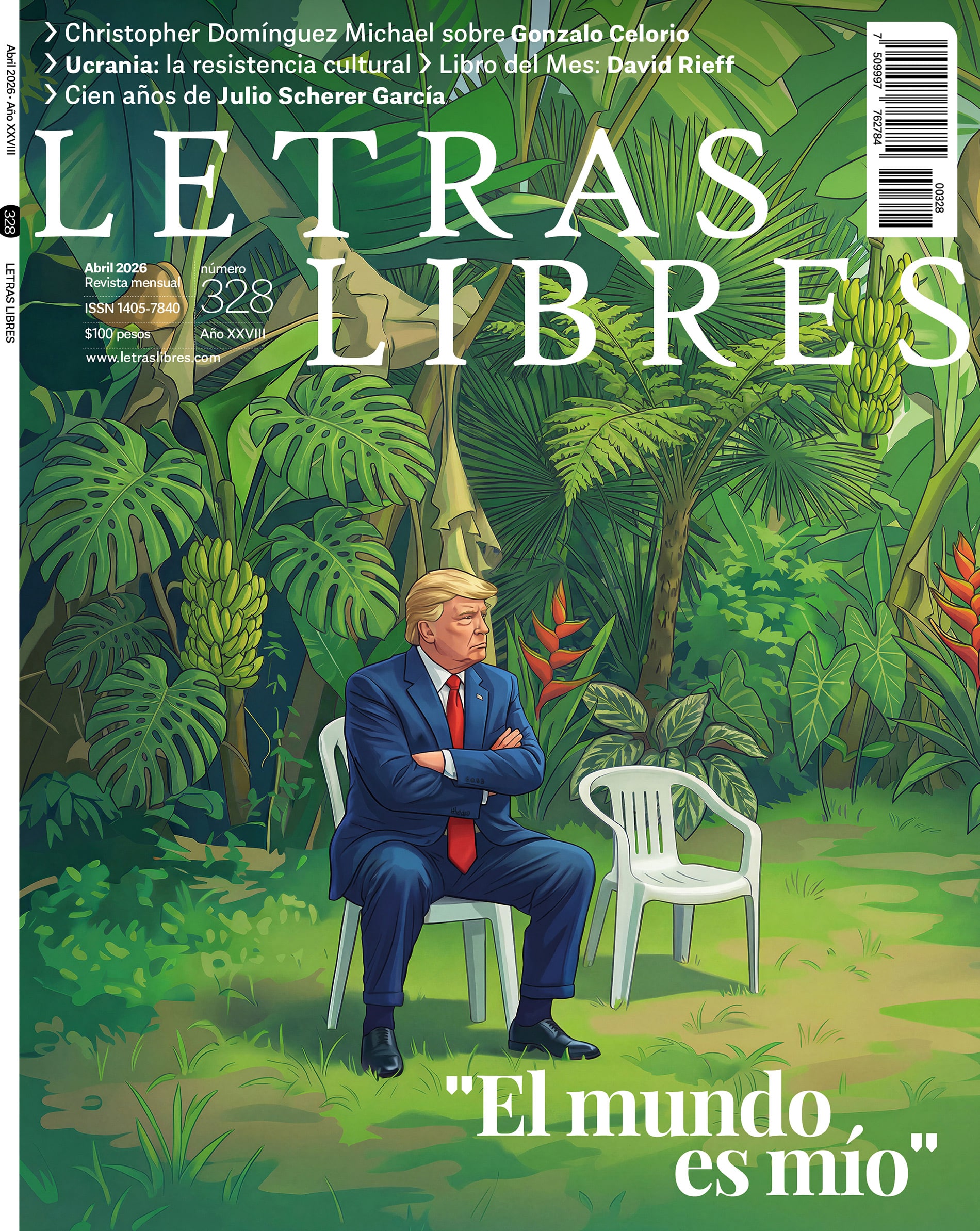

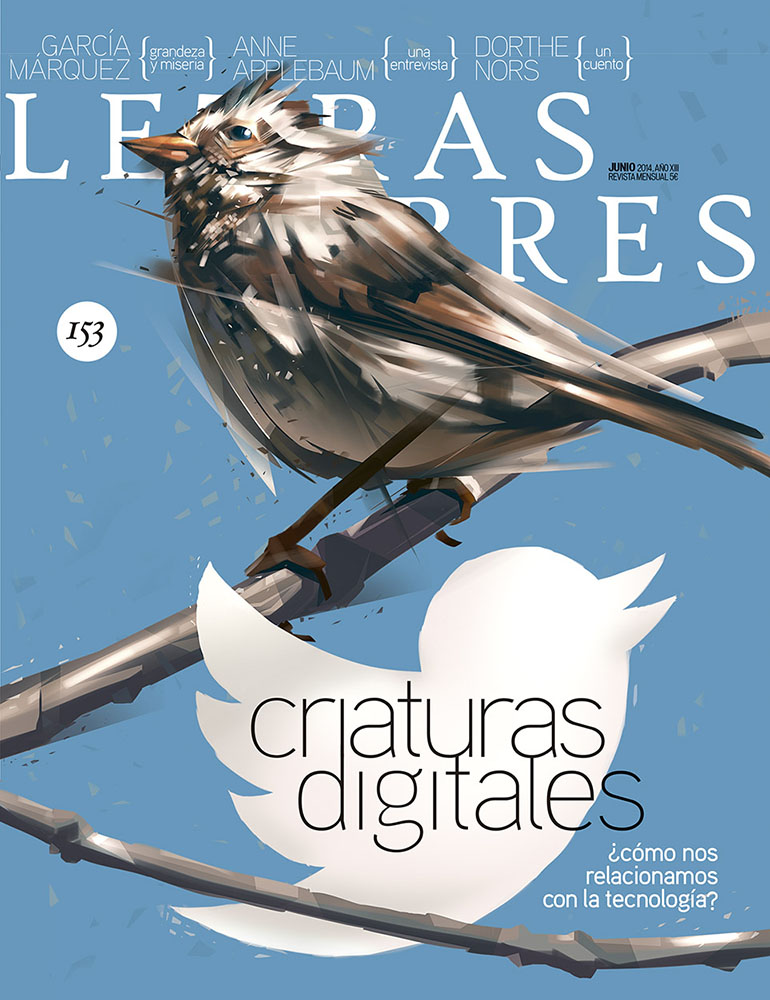

Si pensamos en un escenario clásico de “arriba/abajo”, ya no está claro dónde se alojarían los robots. Las aspiradoras reivindican desde hace años su estatus de asistentes domésticos, pero en los últimos tiempos los especialistas expandirían el dominio de lo robótico desde la realización de tareas hasta la oferta de compañía y atención. No obstante, para dar ese paso es necesario un nuevo tipo de robot, equipado para ser buena compañía. Son robots sociales, programados para tener estados mentales que cambien al interactuar con gente. Por empezar por los que ya existen, podemos considerar, por ejemplo, la muñeca robótica My Real Baby. Si la mueves se alegra; si la mueves demasiado se puede poner de mal humor. O Pleo, un pequeño robot dinosaurio cuya “autonomía” ha destacado la publicidad, o Paro, un bebé foca diseñado como acompañante terapéutico. Como los demás, Paro tiene “estados mentales”, aunque sean primitivos. Interactuar con Paro requiere comprender sus estados, una exigencia de atención que, al final, contribuye a su atractivo. Esas criaturas digitales son las tropas de choque de un momento cultural en el que empieza a parecer natural averiguar cómo se “siente” un robot para llevarse bien con él.

Cuando los robots miran a los ojos, reconocen a la gente e imitan gestos humanos, aprietan nuestros botones darwinianos, y exhiben los tipos de comportamiento que la gente asocia con la sensibilidad, las intenciones y las emociones. En cuanto la gente ve a los robots como criaturas, siente el deseo de atenderles. Con esa sensación llega la fantasía de la reciprocidad: cuando empezamos a preocuparnos por los robots, queremos que se preocupen por nosotros. En nuestra incipiente cultura robótica, el afecto se revela como una aplicación demoledora. Fara, de once años, reacciona a una sesión de juego con Cog, un robot humanoide del MIT que puede mirarla a las ojos, seguir sus posiciones e imitar sus movimientos, diciendo que nunca podría cansarse de ese robot porque “no es como un juguete: a un juguete no le puedes enseñar; es como algo que forma parte de ti, algo que quieres, como otra persona, como un bebé”.

En la actualidad la idea de que los robots son parte del futuro de nuestras relaciones parece natural y goza de amplia difusión, no solo entre expertos. De hecho, está tan difundida que es fácil olvidar que, hasta hace poco, casi nadie la compartía. En la década de 1980, una respuesta común a la presencia de los ordenadores se podía resumir como una “reacción romántica”.1Aceptaba que la gente podría ser una especie de ordenador (una concesión importante a los modelos que presentaban la mente como un programa), pero acentuaba el alma y el espíritu de la máquina humana: el pensamiento simulado podía ser pensamiento, pero la emoción simulada no es una emoción, el amor simulado nunca es amor. Los ordenadores estaban bien, muy bien, si realizaban tareas instrumentales, o tareas que se podían encuadrar con claridad en la categoría del pensamiento. Pero a los objetos computacionales –los robots incluidos– no se les debía permitir la entrada en el terreno de las relaciones humanas.2Por tanto, cuando en 1984 dije que el ordenador era un “segundo ser” y demostré la profunda conexión personal que la gente tenía con él, muchos protestaron insistiendo en una perogrullada: “el ordenador solo es una herramienta”.

A lo largo de la década siguiente, las opiniones cambiaron.3Los ordenadores se convirtieron en objetos cotidianos y se hizo común ver el portátil como una extensión de uno mismo. A mediados de los noventa, “¿Qué llevas en tu PowerBook?” era un buen eslogan publicitario porque reconocía hasta qué punto el escritorio de un ordenador reflejaba compromisos personales e intelectuales. La gente seguía viendo los ordenadores como herramientas, pero reconocía que eran herramientas distintas. Tenían vocaciones especiales: todavía no eran mentes, pero estaban en las fronteras de la mente, estaban cerca de ser mentes cuya opinión contaba.4

En la actualidad, al estudiar las reacciones a los robots sociales –los robots que hacen cosas como mirarte a los ojos, recordar tu nombre y seguir tus movimientos– encuentro a personas que consideran a esos objetos amigos potenciales, confidentes y (añadiendo mejoras técnicas imaginarias) incluso amantes. Escucho lo que hay detrás de esta nueva actitud y percibo tres cosas. Hay una apertura a ver los objetos computacionales como “otras mentes”; existe una disposición a considerar lo que un ordenador y una mente humana tienen en común; y, en un registro distinto, aparecen pruebas de cierta fatiga ante las dificultades que plantea tratar con la gente. Una estudiante de posgrado se me acerca después de una conferencia y me dice que le encantaría cambiar a su novio por un sofisticado robot humanoide siempre y cuando el robot pudiera producir lo que llama “comportamiento afectivo”. Me dice que “necesito una sensación de civilidad en la casa y no quiero estar sola”. Añade: “Si el robot pudiera aportar un ambiente civilizado, estaría encantada de ayudar a producir la ilusión de que hay alguien que de verdad está conmigo.” Lo que busca, dice, es una relación sin riesgo que mantenga a raya la soledad; un robot que reaccione, aunque solo exhiba un comportamiento escrito de antemano, le parece mejor que un novio exigente.

La distancia recorrida a lo largo de los últimos veinte años ha sido impresionante. Bruce, un chico de dieciocho años que entrevisté en 1983, piensa en los ordenadores y los robots como “algo perfecto” y por tanto distintos a la gente. Los robots lo hacen todo bien, la gente actúa lo mejor que puede. Pero para Bruce, la imperfección humana es lo que construye los lazos que nos unen. De forma específica, sus propias limitaciones hacen que se sienta cercano a su padre (“Tengo muchas cosas en común con mi padre… Los dos tenemos caos”). Robots perfectos no podrían entender esa relación tan importante. Veinte años más tarde, Howard, de catorce años, compara a su padre con la idea de un robot terapeuta y el humano es el que no sale bien librado. Howard piensa que el robot tendría una mejor capacidad de entender la complejidad del día a día de un estudiante de secundaria. Comenta lo que aportaría el robot: “Su base de datos sería más grande que la de mi padre. Mi padre conoce cosas básicas, pero no sabe lo suficiente sobre la escuela. Se puede conseguir que los robots entiendan cosas como ‘emociones’.”

Con la convicción de que los robots podrían entendernos, sería más probable que a la gente le agradara su compañía. En presencia de robots sociales la gente siente el vínculo y la pérdida: quieren recordar y sentirse amados. Una japonesa de 64 años que participó en un estudio sobre la relación entre humanos y robots a lo largo de un año dijo de su Wandukun, una criatura robótica peluda diseñada para que se pareciera a un koala: “Cuando miré esos ojos grandes y marrones, me enamoré, después de sentirme sola durante años […] Prometí proteger y cuidar del animalito.”5En mi estudio de los robots en residencias de la tercera edad en Massachusetts, Jonathan, de 74 años, desearía que su muñeca robot My Real Baby fuera un poco más inteligente, porque preferiría hablar con un robot sobre sus problemas que con una persona. “El robot no me critica.” Andy, que también tiene 74 años, dice que My Real Baby, que responde a sus atenciones mostrando distintos estados mentales, guarda cierto parecido con su exmujer, Rose: “Algo en la mirada.” Le gusta hablar con el robot sobre los acontecimientos del día. “Cuando me levanto por la mañana y le veo la cara [la del robot], es una sensación muy agradable, como si alguien me estuviera cuidando.”

Hace poco tuve una conversación con compañeros que escribieron sobre la combinación de Yo-Tú que se da entre gente y robots y pensé que Martin Buber se revolvería en su tumba. El yo era la persona de la relación, pero ¿cómo podía ser tú el robot? En el pasado, me habría centrado en la forma en que mis colegas proyectaban emociones en un robot que no podía tenerlas. Pero había adoptado esa posición al interpretar las actitudes hacia los robots como una especie de test de Rorschach para entender mejor las esperanzas y frustraciones de la gente. Ahora, había una nueva seriedad, una nueva mentalidad literal a la hora de pensar en un compañero robot. Mis colegas veían el robot entre bambalinas y estaban impacientes por que llegara al escenario.

Parecía que no había pasado nada de tiempo cuando saIió un libro, Love and sex with robots, y un reportero de Scientific American me entrevistó sobre la psicología del matrimonio con robots.6La conversación me pareció memorable. Me preguntó si mi oposición a que la gente se casara con robots no me ponía en el mismo campo que el de quienes se oponían al matrimonio entre lesbianas o gays. Intenté explicar que el hecho de que no pensara que la gente pudiera casarse con máquinas no significaba que no me pareciera bien cualquier mezcla de gente con gente. El reportero me acusó de chovinismo de especie. ¿No era ese el tipo de terminología que usaban los homófobos, cuando no consideraban a los gays personas de “verdad”? Estaba claro que nuestra cultura había llegado a un lugar nuevo.

Para mí, los robots representan una nueva versión de lo ominoso en nuestra cultura de la simulación. Me refiero a lo ominoso en el sentido que empleaba Freud: algo conocido desde hace tiempo y familiar, pero que ahora resulta extrañamente poco familiar.7No son como las muñecas del pasado que ofrecían posibilidades de pura proyección. Los nuevos robots relacionales están construidos con psicologías y necesidades propias. Como objetos ominosos, en las fronteras de las categorías, las criaturas robóticas nos provocan preguntas sobre las categorías tradicionales, preguntas como: “¿Qué tipo de relaciones es apropiado tener con máquinas?” Y, de forma más general: “¿Qué es una relación?” La cuestión no es si los niños acabarán amando a sus robots más que a otros niños o a sus padres, sino cuál será el significado de amar.

El psicoanalista Heinz Kohut describe cómo algunas personas pueden reforzar temporalmente su frágil ego convirtiendo a otra persona en un objeto del sí mismo (self-object).8En el papel del objeto del sí mismo, se percibe al otro como parte del propio ser, en perfecta armonía con el frágil estado interior del individuo. Las decepciones son inevitables. Las relaciones que forma la gente en redes sociales (en MySpace o Facebook o en mundos virtuales) son excelentes aspirantes al papel del objeto del sí mismo. Ahí llegamos a conocer a la gente a través de una curiosa luz: podemos imaginar que son lo que el frágil ego necesita que sean.9

De forma similar, los robots que nos miran a los ojos, siguen nuestros movimientos y quizá dicen nuestro nombre pueden presentarse como candidatos para el papel de objeto del sí mismo. Si pueden parecer vivos y no decepcionan, quizá tengan hasta una “ventaja comparativa” sobre la gente en esta tarea, y por tanto puedan abrir nuevas posibilidades para la experiencia narcisista con máquinas. ¿Por qué digo “ventaja comparativa”? Cuando la gente convierte a otras personas en objetos del sí mismo, se podría decir que hace un esfuerzo por transformar a una persona en una especie de “pieza de recambio” en vez de aceptarla como una personalidad autónoma e individual. Por supuesto, el compañero artificial o robot ya es una pieza de recambio.

Los atractivos del robot ofrecen una ventana que muestra cuánta gente se siente tentada de evitar los encuentros con amigos y familiares. Cargada de exceso de estrés y trabajo, la gente aduce cansancio y tareas pendientes. Sentirse solo es un estar solo que sale mal. ¿Las conexiones cibernéticas están preparando el camino para considerar suficientes a los compañeros robóticos? En esta época, la gente admite sin problemas que prefiere dejar un mensaje de voz o mandar un correo electrónico a un encuentro cara a cara. Y, a partir de ahí, dicen: “Preferiría hablar con un robot. Los amigos pueden ser agotadores. El robot siempre está ahí. Y, cuando termino, puedo marcharme.” Como una mujer dijo de aibo, el robot doméstico de Sony, “es mejor que un perro de verdad […] No hace nada peligroso y no te traiciona […] Además, no se morirá de repente dándote un disgusto enorme”. La reacción romántica a la presencia del ordenador acentuaba que la simulación no tenía lugar en cuestiones amorosas. En la actualidad, se especula con la posibilidad de que los humanos, como los robots, usen la simulación para salir adelante. Una persona de treinta años lo expresa de este modo: “¿Cómo sé que mi amante no está simulando todo lo que dice sentir?” Un hombre de 59 años dijo: “Mi primera mujer fingió sus orgasmos durante veinticinco años… ¿en qué sentido no es auténtico un robot? Ella dejó el listón bastante bajo.” O la estudiante de posgrado que estaba dispuesta a “ayudar a producir la ilusión de que alguien está realmente conmigo” si un robot diera un poco de información adicional.

En la década de 1980, la gente insistía en que la esencia de la unicidad humana era lo que los ordenadores no podían hacer o ser, y se concedía especial valor a la importancia del ciclo de la vida humana a la hora de definir lo que era esencial para ser una persona. Un hombre, al considerar la posibilidad de confiar en un ordenador psicoterapeuta, expresó ese concepto con estas palabras: “¿Cómo puedo hablar de la rivalidad entre hermanos con alguien que no tuvo madre?” Concedía un valor especial a la idea de que solo la gente puede dar comprensión y empatía. Partía de que hay algo esencial en el espíritu humano, y de que esa cualidad esencial reside en estados humanos interiores. Ahora se cuestiona esa suposición esencialista. Lo que importa es cómo actúan los robots y cómo actuamos unos para otros: la esencia, después de todo, de la vida en las comunidades virtuales donde creamos un avatar y lo colocamos en un escenario autoconstruido. Si nos centramos en el comportamiento en vez de los estados interiores, una criatura que se comporta de forma apropiada es una criatura apropiada.

En la década de 1980, los debates sobre la inteligencia artificial se centraban en la cuestión de si las máquinas podían ser inteligentes “de verdad”. Esos debates trataban de los propios objetos, de lo que podían y no podían hacer. Nuestros nuevos debates sobre las máquinas relacionales y sociales –debates que tendrán una creciente importancia en la cultura mainstream– no solo tienen que ver con la capacidad de las máquinas sino también con nuestras vulnerabilidades, frente a las máquinas que aprietan nuestros botones darwinianos y frente a la promesa de la relación, cualquier relación, en un mundo en el que los humanos resultan a menudo decepcionantes. Para muchos de los que se sienten solos pero temen la intimidad, el robot ofrece la ilusión de la compañía sin las exigencias de una amistad íntima prolongada. Uno puede ser solitario sin sentirse nunca solo. Es un pequeño paso desde esa posición a la pregunta: ¿Cuál es el propósito de los seres vivos?

Desde la perspectiva de los jóvenes de hoy, las respuestas quizá no sean obvias. Recordemos el caso de Howard, de catorce años, que piensa que los robots pueden ser mejores que la gente en lo que respecta a comprender la complejidad de la escuela, y el de Fara, de once años, a quien le gustaría atender a un robot parecido a un bebé. En cuanto a mí, la pregunta me toca de cerca. Llevé a mi hija, que entonces tenía catorce años, a ver la exposición sobre Darwin en el Museo Americano de Historia Natural. La exposición trataba de la vida y el pensamiento de Darwin y, con un tono algo defensivo (motivado por los ataques a la evolución de los defensores del diseño inteligente), presentaba la teoría de la evolución como la verdad central que apuntala la biología moderna. La exposición de Darwin quería convencer y agradar. En la entrada había una tortuga de las Islas Galápagos, un elemento seminal en el desarrollo de la teoría de la evolución. La tortuga estaba en su jaula, totalmente quieta. “Podían haber usado un robot”, comentó mi hija. Le parecía una vergüenza llevar a la tortuga hasta allí y meterla en una jaula para algo que depende tan poco de la “vida” de la tortuga. Me impactaron sus comentarios, compasivos con la tortuga presa porque estaba viva e indiferentes a su autenticidad. El museo había anunciado esas tortugas como maravillas, curiosidades, prodigios: entre los modelos de plástico de la vida en el museo, aquí está la vida que vio Darwin.

Empecé a hablar con otros visitantes de la exposición, padres e hijos. Era el fin de semana del Día de Acción de Gracias. La cola era larga y no se movía. Mi pregunta “¿te importa que la tortuga esté viva?” era una distracción bienvenida. Una chica de diez años prefería un robot tortuga porque la vida tiene un inconveniente estético: “el agua está sucia. Qué asco”. Pero era más frecuente que los votos por los robots repitieran la impresión de mi hija de que en ese lugar la cualidad de estar vivo no parecía merecer tantas molestias. Una niña de doce años opinó: “Para lo que hacen las tortugas, no hacía falta que estuvieran vivas.” Su padre la miró, sin entender: “Pero el asunto es que estén vivas, esa es la clave.”

La exposición de Darwin daba a la autenticidad una gran relevancia: se mostraba el cristal de aumento que usaba Darwin, los verdaderos cuadernos de notas en los que apuntaba sus observaciones, de hecho, el mismo cuaderno en el que escribió las famosas frases que describieron por primera vez su teoría de la evolución. Sin embargo, en las reacciones de los niños a la tortuga Galápagos, inerte pero viva, la idea de lo original estaba en crisis. Recuerdo la reacción de mi hija, cuando, a los siete años, dio una vuelta en bote por un Mediterráneo de postal. Ya era una experta en el mundo de los acuarios simulados; vio una criatura en el agua, la señaló excitada y dijo: “¡Mira, mamá, una medusa! ¡Qué realista parece!” Le conté la historia a un amigo que era científico investigador en la Walt Disney Company, y no se sorprendió. Cuando se inauguró Animal Kingdom en Orlando, poblado por lo “real”, es decir, animales biológicos, los primeros visitantes se quejaron de que esos animales no eran tan “realistas” como las criaturas animatrónicas que tenía Disney World al otro lado de la carretera. Los robóticos cocodrilos chapoteaban con sus colas, ponían los ojos en blanco, en suma, presentaban el comportamiento “esencial del cocodrilo”. Los cocodrilos biológicos, como la tortuga Galápagos, iban más bien a lo suyo. ¿Cuál es la regla dorada?

Hace mucho que creo que, en nuestra cultura de la simulación, la idea de autenticidad es para nosotros lo que el sexo era para los victorianos: amenaza y obsesión, tabú y fascinación. He convivido muchos años con esta idea, pero, en el museo, la posición de los niños me resultó extrañamente perturbadora. Para ellos, en este contexto, la cualidad de estar vivo no parecía tener valor intrínseco. “Si pones un robot en vez de la tortuga viva, ¿te parece que habría que decirle a la gente que la tortuga no está viva?”, pregunto. “No”, dijeron varios niños. Los datos sobre “la cualidad de estar vivo” se pueden compartir obedeciendo la base de “necesidad de saber”, por un propósito. Al final, se puede plantear una pregunta, que es una provocación y un desafío: ¿Cuáles son de verdad los propósitos de los seres vivos? ~

Traducción de Daniel Gascón.

Apareció en el libro Close engagements with artificial companions (John Benjamins Publishing Company, 2011).

2Ibíd.

3Sherry Turkle, La vida en la pantalla: la construcción de la identidad en la era de internet, Barcelona, Paidós, 1997. Allí hablo del caso de la psicoterapia informática para ilustrar el alejamiento de la reacción romántica como respuesta a programas que actúan como compañeros en el terreno de lo personal.

4Ibíd.

5Suvendi Kakushi, “Robot Loving”, Asia Week Magazine, 9 de noviembre de 2001. Acceso el 5/ix/2005.

6 David Levy, Amor y sexo con robots: la evolución de las relaciones entre los humanos y las máquinas, Barcelona, Paidós, 2008.

7 Sigmund Freud, “Lo ominoso”, en Obras completas, Buenos Aires, Amorrortu, 1979, vol. xvii.

8 P. H. Ornstein (ed.), The Search for the Self: Selected Writings of Heinz Kohut: 1950-1978, vol. 2, Nueva York, International Universities Press, Inc., 1978.

9Sobre este asunto véase Sherry Turkle, “Whither Psychoanalysis in Computer Culture”, Pshychoanalytic Psychology, vol. 21, 2004.

(Nueva York, 1948) es profesora de estudios sociales de ciencia y tecnología del programa de ciencia, tecnología y sociedad en el MIT, fundadora y actual directora del MIT.