Pocos cuestionarán que el deseo de conocer en general está sujeto a ciertos límites morales. Por muy grande que sea el interés de alguien en conocer el estado de salud de sus amigos y vecinos, no tiene ningún derecho a acceder a su historial médico sin su consentimiento, y sería inmoral (e ilegal) que lo hiciera. Por muy intensa que sea la curiosidad de un aficionado por las estrategias de juego que va a seguir el próximo domingo el entrenador de su equipo favorito, eso no obliga al entrenador a comunicárselas, y si, por algún azar o artimaña, llegara a saberlas (sobornando a algún técnico, por ejemplo), su divulgación sería como mínimo una traición al equipo. Sabemos, pues, que en nuestra vida cotidiana el conocimiento no es un valor absoluto, que la confianza de nuestros amigos o la victoria de nuestro equipo valen más que la posesión de ciertos conocimientos.

Esta convicción, que parece fácil de justificar, se vuelve en cambio muy problemática cuando hablamos del conocimiento científico. Hasta el punto de que es común juzgar los intentos de limitarlo como muestra de una voluntad inquisitorial, o como una reedición del caso Lysenko, que arruinó durante décadas (mediados de los 30 a mediados de los 60) la genética en la Unión Soviética y se llevó por delante muchas vidas y haciendas, entre ellas, la del genetista Nikolái Vavílov, máximo representante de esta ciencia en aquel momento. Vavílov murió de malnutrición en la cárcel en 1943 por oponerse a las maniobras de Trofim Lysenko para acabar por razones ideológicas con la genética mendeliana, y de nada le sirvió ser miembro del Soviet Supremo ni haber recibido en su día el premio Lenin.

¿Hemos de aceptar entonces que la libertad de investigación es un valor absoluto y que cualquier pretensión de establecer cortapisas morales o legales bastaría para hacer revolverse a Galileo en su tumba? ¿O hay, por el contrario, razones defendibles para sostener que debe estar sometida, como otros derechos fundamentales, a ciertas limitaciones, incluso hasta el extremo de prohibir, si se viera necesario, la adquisición de ciertos conocimientos posibles? ¿Equivaldría esta prohibición a una censura ejercida por motivos ideológicos? ¿Hay alternativas a dicha prohibición?

Procedimientos inmorales

Este es un tema peliagudo cuya discusión despierta con frecuencia la tentación de ofrecer respuestas poco meditadas. Ya lo dijo hace más de cuarenta años el bioeticista David H. Smith: “En ciertos círculos, las propuestas de restricción de algunas investigaciones son tratadas no solo con la condescendencia normalmente empleada con los idiotas, sino con la intolerancia reservada por lo generalmente para los pervertidos morales” (Smith 1978, p. 30). Una explicación de esta actitud es que la libertad de investigación, junto con la libertad de cátedra, son piezas esenciales de la vida académica en cualquier sistema democrático, y se consideran no solo derechos fundamentales intocables, protegidos en muchos casos constitucionalmente, sino requisitos imprescindibles para el progreso de la ciencia. Por ello, las pretensiones de limitación o control tienden a verse como movimientos contrarios a la libertad promovidos por zelotes ideológicos que solo buscan imponer sus dogmas con más facilidad.

En la discusión sobre el tema se emplea la rotunda expresión de “conocimiento prohibido” para referirse a esos supuestos conocimientos que no deberían alcanzarse jamás. Expresión que, en efecto, trae a la memoria algunos de los peores episodios de nuestra historia. Se entiende por tal aquel “conocimiento considerado como demasiado sensible, peligroso o tabú como para ser producido o compartido” (Hagendorff 2020, p. 1).

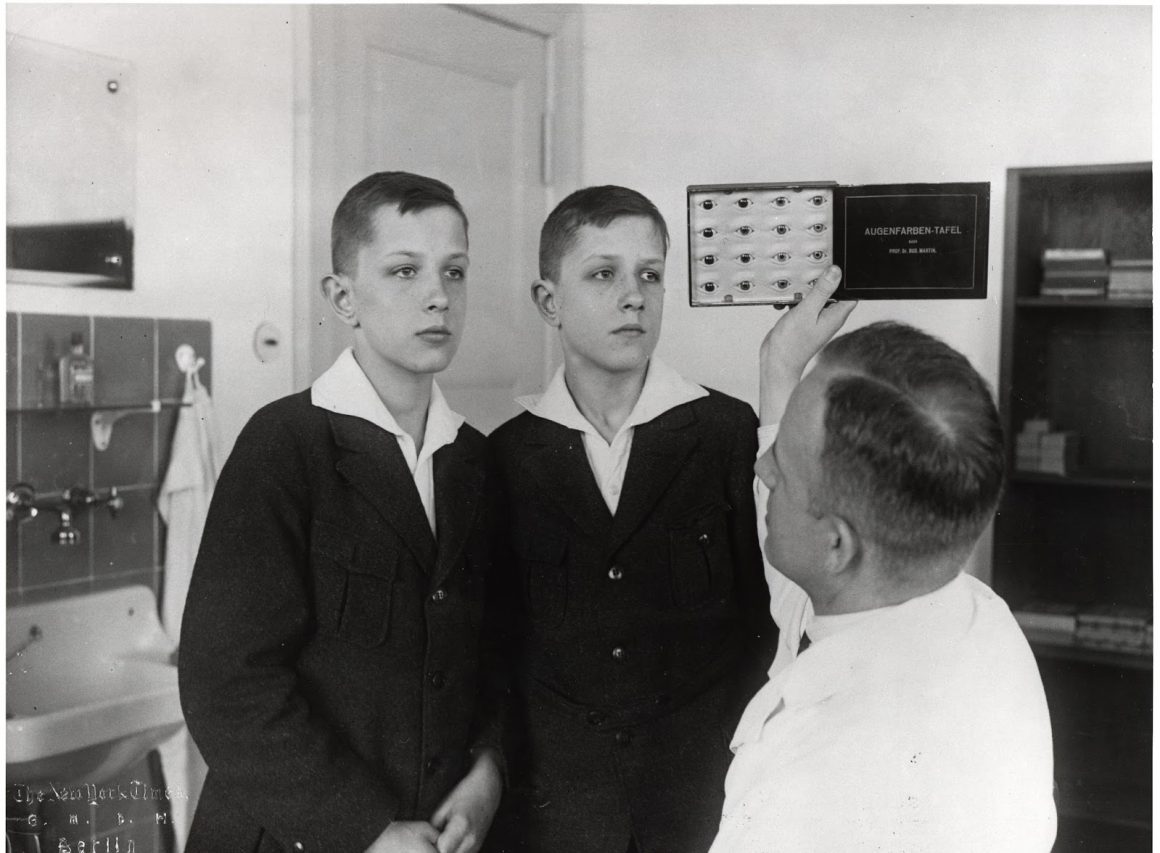

Nicholas Rescher, uno de los pocos filósofos que se ha atrevido a considerar el tema con detenimiento (otros nombres que vale mencionar son los de Helen Longino, Peter Singer y Philip Kitcher), recuerda un ejemplo de conocimiento científico que fue rechazado por razones morales: el obtenido en los campos de concentración nazis (Rescher 1987, cap. 1). Como se puso en evidencia en los juicios de Núremberg, allí se investigó con los prisioneros sobre varias cuestiones médicas, como, por ejemplo, la tolerancia de los humanos a las altas o bajas presiones atmosféricas y a las bajas temperaturas. No se dudó para ello en someterlos a verdaderas torturas que acabaron frecuentemente con la muerte.

Sin embargo, como también nos recuerda Rescher, sí se utilizaron los conocimientos obtenidos con prisioneros durante la guerra por los japoneses, en circunstancias no demasiado diferentes, experimentando sobre agentes tóxicos, químicos y biológicos. Estos resultados eran, al parecer, mucho más interesantes para las autoridades militares aliadas.

Se puede aducir, con razón, que en estos casos la prohibición de usar esos conocimientos estuvo justificada porque se obtuvieron mediante procedimientos o métodos inmorales, pero que eso no se debe extender (como no se hizo) al tema de estudio. Según esto, sería legítimo regular y prohibir por motivos éticos ciertos procedimientos de investigación y lo mismo podría decirse de ciertas aplicaciones del conocimiento, pero no cabe restringir ni los temas ni los contenidos de la investigación. En los países democráticos, en efecto, las normativas existentes regulan los medios para la investigación y las aplicaciones prácticas que salen al mercado, pero sobre los temas solo los científicos deciden, siempre que encuentren financiación para su estudio.

La negación de fondos para la investigación o la no aceptación de un artículo para su publicación por deficiencias éticas en los procedimientos son relativamente frecuentes en los ámbitos más problemáticos de las ciencias y las ingenierías (un buen ejemplo sería el del científico chino He Jiankui, al que no se le aceptó su artículo sobre la edición genética de dos niñas gemelas), mientras que no se ha dado nunca hasta ahora la prohibición expresa de investigar sobre un determinado asunto. A lo sumo, se han decretado algunas moratorias que han ejercido una cierta presión moral sobre los especialistas, pero que han terminado siempre por levantarse.

Los límites de la tecnociencia

A tal efecto, suele trazarse una distinción nítida entre la ciencia pura, la ciencia aplicada y la tecnología. Se considera que la primera debe estar exenta de cualquier restricción, mientras que serían las aplicaciones concretas del conocimiento científico o ciertos desarrollos tecnológicos los que pueden e incluso deben ser regulados. Sin embargo, lo cierto es que el surgimiento de las tecnociencias a partir de la Segunda Guerra Mundial, es decir, de disciplinas y proyectos de investigación en los que el conocimiento teórico está estrechamente imbricado con su aplicación técnica, ha hecho que esta separación tajante entre el conocimiento y su uso tecnológico se vuelva más difícil (Echeverría 2003). No toda la investigación actual puede calificarse de tecnocientífica, pero sí en buena parte de la que se produjo en los campos hemos visto un progreso más rápido, como es el caso de la genética, la biología molecular, la farmacología, la biología sintética, las ciencias biomédicas, la física de materiales o las ciencias de la computación, incluyendo a la inteligencia artificial.

Las amenazas cada vez más evidentes de un desarrollo tecnocientífico descontrolado, realizado en un porcentaje creciente desde grandes corporaciones privadas, así como la proliferación de tecnologías de doble uso, que podrían ser utilizadas para fines perversos, han contribuido a que la cuestión se haya planteado de nuevo, y en términos acuciantes. El debate, en efecto, se ha dado en varias ocasiones a lo largo de las últimas décadas. Uno de los momentos más intensos fue en 2011, a raíz de la posible publicación de un artículo, que finalmente vio la luz en la revista Nature en 2012, en el que se describía una manipulación del virus N5H1 (el de la gripe aviar) que lo hacía más contagioso en mamíferos y, por tanto, también en humanos. Recuérdese que este virus mató casi al 60% de los varios centenares de infectados. La NSABB (National Science Advisory Board for Biosecurity) había recomendado que no se publicara el artículo, dado el peligro de que esos conocimientos fueran utilizados por bioterroristas. Era la primera vez que hacía una recomendación así, aunque luego revirtió su decisión.

Anteriormente, en 2002, se había suscitado una discusión análoga a raíz de la publicación de la descripción de la síntesis del virus de la polio usando ADN que podía conseguirse por correo. Y en 2005 un equipo de científicos norteamericanos fue capaz de reconstruir el terrible virus de la gripe española a partir de material obtenido en un cadáver encontrado en Alaska; un virus que mató a más de cincuenta millones de personas (Kourany 2016). También en el campo de la inteligencia artificial se discute desde hace algún tiempo en qué casos se debe permitir el acceso al código fuente o, por el contrario, se debe limitar la accesibilidad. El énfasis está puesto aquí no tanto en la investigación como en la publicación de los resultados de forma completa y detallada.

Pero ¿qué ocurre si un tema no tiene demasiado interés intrínseco, porque no aportaría gran cosa al aumento de nuestro conocimiento sobre el mundo, y, sin embargo, su indagación pudiera tener consecuencias muy dañinas para algunas personas? Quizás no tenga mucho sentido afirmar que hay conocimientos cuya posesión es intrínsecamente inmoral (hay quien sostiene que solo esto debería considerarse como conocimiento prohibido stricto sensu), pero podemos imaginar casos en los que prácticamente cualquier aplicación de ese conocimiento sería dañina para los seres humanos y, por tanto, no sería entonces descabellado deliberar seriamente sobre la conveniencia de prohibir cualquier investigación encaminada a su obtención. Supongamos que alguien quiere averiguar si se puede dotar de mayor autoconsciencia e inteligencia a un simio, o quiere investigar sobre la posibilidad de modificar un virus para que afecte de forma especial a determinados grupos étnicos, o busca sintetizar una droga que permita controlar a voluntad a otro ser humano de forma inadvertida y en largos periodos de tiempo. ¿Tendría sentido en estos casos no poner límites a la búsqueda de esos conocimientos, sino solo a su difusión o aplicación?

La ciencia de las diferencias raciales

Uno de los temas que suscita recurrentemente este debate es el de los estudios sobre diferencias raciales (o de género) en inteligencia. Estos estudios son siempre problemáticos porque, para empezar, no hay consenso sobre la existencia objetiva de razas ni sobre lo que realmente miden los test de inteligencia. Pero, sobre todo, el problema está en los resultados. Si no confirman la tesis de la desigualdad, ¿beneficiará eso en algo a los afectados? Y si, por el contrario, confirman la tesis de la desigualdad, ¿perjudicará eso a los afectados?

Es clara la asimetría que aquí se produce, como se ha encargado de subrayar Philip Kitcher (2001, cap. 8), puesto que muy probablemente, si se da el primer resultado, el beneficio será mínimo, mientras que, si se da el segundo, el perjuicio podría ser enorme. Cualquier grado de confirmación, por débil que sea, de la hipótesis de la existencia de diferencias raciales o de género en inteligencia aumentará mucho más la creencia en la existencia de esas desigualdades, y en que son las que explican las situaciones sociales existentes, de lo que sería capaz de reducir esa creencia la refutación empírica de la hipótesis.

Los que piden la prohibición de este tipo de estudios no buscan censurar una investigación pura y desinteresada por razones políticas, sino cuestionar política y epistémicamente aquella investigación que, cuando se lleva a cabo, se espera desde el primer instante que tenga consecuencias políticas y sociales que agraven la situación de muchas personas. No se trata de algo comparable a lo que sucedió en el caso Lysenko, en el que la genética mendeliana fue rechazada porque Lysenko, Stalin y otros la consideraron incompatible con la doctrina marxista. Este fue un caso claro de censura ideológica totalitaria que tuvo consecuencias terribles. Poco o nada tiene que ver con las propuestas de control sobre investigaciones potencialmente dañinas, que representan peligros reales para personas concretas, con nombres y apellidos.

No es el conflicto ideológico (que ciertamente lo hay) lo fundamental aquí, ni estamos ante el enfrentamiento entre la razón y el oscurantismo, sino solo ante la difícil elección entre diversos valores (la libertad de investigación y los posibles beneficios de saber algo frente a la igualdad y el bienestar) con el fin de evitar daños claramente identificables. Entre ellos estaría, por ejemplo, el afianzamiento de las condiciones que hacen que esas personas vean mermada la posibilidad de acceder plenamente a sus derechos, como el derecho a la educación, y, con ello, al posterior disfrute por su parte del ejercicio de la misma libertad de investigación que tanto se valora.

Dicho de otro modo, para los que defienden la prohibición de estas investigaciones no se trata de prohibir verdades sobre el mundo porque resulten incómodas para grupos de poder, sino de no dar por verdaderas sin suficiente fundamento ideas que tendrían muy probablemente efectos negativos difíciles de revertir. En tales casos es mucho peor hacer pasar por conocimientos científicos sólidos lo que podrían ser meras especulaciones o hipótesis con dudosa base empírica detrás. Y difícilmente puede creerse, por otro lado, que los científicos sociales que eligen este tema están desprovistos de cualquier sesgo ideológico y solo les mueve la curiosidad intelectual. Compararlos con Galileo o Vavílov no deja de esconder una pretendida ingenuidad. Lo apunta con precisión Mauricio Suárez (2012): “la ciencia se asienta sobre la firme voluntad, fundada en las revoluciones científicas y sociales de la ilustración, de superar prejuicios, mitos y tabúes. Pero no todo el conocimiento es necesario o está justificado, en cualquier momento, en cualquier contexto, o a cualquier precio”.

No obstante, y pese al revuelo que se suele causar, en este asunto concreto son muy pocos los que han exigido la prohibición expresa de toda investigación. Una de las razones principales la señala también Kitcher. La prohibición de investigar las diferencias raciales en los test de inteligencia puede tener efectos contraproducentes, puesto que incitaría a muchos a pensar que, si se prohíben este tipo de estudios es porque, en efecto, existen esas diferencias y por motivos ideológicos no se quieren reconocer. La prohibición no haría entonces sino reforzar los prejuicios raciales de esas personas. Pensarían que es un hecho incómodo pero innegable que ciertas razas tienen un menor CI y que esto se oculta porque vivimos en un mundo capaz de sacrificar la libertad de investigación ante el ídolo de la corrección política.

En última instancia, este tipo de prohibiciones podría llevar a una pérdida de credibilidad en la propia investigación científica. Se la consideraría politizada y filtrada por intereses espurios y, por tanto, no merecedora de confianza. Y no es este el único problema que se ha aducido en contra de la pretensión de prohibir investigaciones que se consideren éticamente censurables. Entre los otros destacan la dificultad de cualquier regulador para supervisar una investigación tecnocientífica que corre de forma acelerada, la imposibilidad de hacer efectivo un verdadero control internacional de la prohibición, la imposibilidad de predecir las consecuencias de la prohibición, algunas de las cuales puede ser muy negativas, y los factores externos (ideológicos, religiosos, personalistas, etc.) que pueden sesgar la decisión de llevar a cabo la prohibición (Marchant y Pope 2009).

En defensa del rigor metodológico

La propuesta alternativa de Kitcher es la de crear las condiciones para eliminar en lo posible los prejuicios epistémicos que lastran determinadas hipótesis y que inducen a conclusiones erróneas. Prejuicios que, como puede documentarse bien en el pasado, llevan con frecuencia a sustentar posiciones firmes sobre evidencias que, sin embargo, no son concluyentes. Por ello, él cree que en este tipo de casos que estamos discutiendo cobra sentido la implementación de controles metodológicos más estrictos que, por ejemplo, impidan la sobrevaloración de una evidencia débil.

No parece que sea demasiado pedir que en tales circunstancias las exigencias de rigor metodológico se refuercen, sobre todo si tenemos en cuenta que el reclamo de un mayor rigor metodológico se empieza a escuchar en muchas ciencias. El aumento vertiginoso de artículos retractados en revistas de prestigio en los últimos años (60.000 en 2015, según el diario Le Monde) y, aunque esto es difícil de establecer con precisión, el alto porcentaje de experimentos publicados que se muestran luego como irreproducibles (Flier 2017) han sido el detonante de este reclamo.

Según una encuesta realizada por Nature entre 1.500 científicos, más del 70% de ellos han intentado sin éxito reproducir los experimentos de otros científicos, y más de la mitad no han podido reproducir sus propios experimentos (Baker 2016). La proliferación de revistas depredadoras, en las que previo pago se puede publicar sin apenas control de pares, la popularización de los archivos preprint en línea, de los cuales menos de la mitad se publican finalmente en revistas con evaluación de pares, y la extensión del fraude científico debido a la presión siempre creciente por publicar, no han hecho sino agravar el problema.

Aunque el autocontrol de los científicos sigue siendo el ideal de libertad de investigación para muchos de ellos, en la actualidad parece claro que, por mucho que deba considerarse un recurso importante, resulta insuficiente en determinadas circunstancias. Como hemos dicho antes, buena parte de la investigación tecnocientífica se realiza bajo los auspicios de las empresas privadas. Siendo realistas, no cabe desconocer que la insistencia en el autocontrol equivaldría a dejar al menos esa parte de la investigación en manos de los directivos de las empresas o de los consejos de administración, no de los propios científicos.

De ahí que en los últimos años haya aumentado el interés por la imprescindible gobernanza de la ciencia, por la incardinación de la ciencia en una sociedad democrática. Esa gobernanza puede tomar muchas formas, algunas de ellas todavía probablemente por descubrir, pero ya existen importantes manifestaciones de ella en los países con mayor desarrollo científico, como lo muestra el surgimiento de agencias como la anteriormente mencionada NSABB.

Tenemos ya un amplio elenco de recomendaciones, códigos de conducta, protocolos éticos, prioridades en la financiación, etc. que, si bien siguen despertando recelos y la contestación en una parte de los investigadores, suelen ser acogidos con naturalidad por la mayoría de ellos, y someten sus trabajos a los dictámenes correspondientes. Las prohibiciones han quedado limitadas habitualmente a la utilización de ciertos procedimientos experimentales que puedan causar perjuicios a los seres humanos y a los animales. No hay investigación sensible que se financie con dinero público que no pase por una previa autorización de un comité de ética o similar.

Según Kempner et al. (2005), hasta un 42% de los científicos encuestados al respecto en los Estados Unidos se han sentido censurados en alguna ocasión Sin embargo, las mismas encuestas dejan ver que los científicos prefieren directrices claras sobre las líneas recomendables para el desarrollo de sus investigaciones a encontrarse con impedimentos o dificultades posteriores por razones poco explícitas. Como escribió Peter Singer, “Un sistema responsable de comités éticos consume tiempo y en ocasiones se llegará a conclusiones erróneas, pero es difícil pensar en un modo mejor de trazar la línea [entre lo que es éticamente aceptable y lo que no]” (Singer 1996, p. 221). A todo ello debería añadirse la conveniencia de una sólida formación ética por parte de científicos e ingenieros, incorporada a ser posible a sus estudios técnicos, que fomente la responsabilidad individual y profesional en el trabajo científico. Sería un buen modo de reforzar el preconizado autocontrol de los investigadores.

Es evidente que en esta tarea reguladora deben evitarse los excesos. Resulta lamentable que se hayan prohibido en ocasiones ciertas investigaciones por razones exclusivamente religiosas o ideológicas (como en el caso de las células madres embrionarias). Una excesiva regulación, que siempre genera la correspondiente burocracia, puede agostar la investigación y desanimar a los científicos en sus carreras. Sin embargo, no es probable que la prohibición universalmente aceptada de la investigación sobre clonación reproductiva en humanos disguste a muchos. La reacción frente a los excesos no debe llevar a la eliminación de toda regulación. La política del completo laissez-faire no es aceptable para afrontar los desafíos del desarrollo tecnocientífico, y, de hecho, puede decirse que desde que existe la tecnociencia nunca lo ha sido. La dificultad está en los modos de implementar el control y con qué criterios, o, por decirlo en la terminología de Kitcher, la dificultad está en saber cómo conseguir una ciencia “bien ordenada”.

Otro asunto estrechamente relacionado que aquí no podemos tratar es el de la investigación científica con objetivos militares. Las restricciones éticas deberían tener validez también para ellas, pero las condiciones para su control público son virtualmente inexistentes.

Agradezco a Félix Ovejero Lucas y a Mauricio Suárez Aller sus comentarios al borrador de este artículo.

Referencias

Baker, M. 2016. “1500 scientists lift the lid on reproducibility”. Nature, 533, pp. 452-454. https://doi.org/10.1038/533452a

Echeverría, J. 2003. La revolución tecnocientífica, Madrid: Fondo de Cultura Económica.

Flier, J.S. 2017. “Irreproducibility of published bioscience research: Diagnosis, pathogenesis and therapy”. Molecular Metabolism, 6(1), pp. 2-9.

Hagendorff, T. 2020. “Forbidden knowledge in machine learning reflections on the limits of research and publication”. AI & Society. https://doi.org/10.1007/s00146-020-01045-4

Kempner, J., C.S. Perlis y J.F. Merz 2005. “Forbidden Knowledge”. Science, 307, p. 854.

Kitcher, Ph. 2001. Science, Truth, and Democracy, Oxford: OUP.

Kourany, 2016. “Should Some Knowledge Be Forbidden? The Case of Cognitive Differences Research”. Philosophy of Science, 83(5), pp. 779-790.

Marchant, G.E. y L.L. Pope 2009. “The Problems with Forbidding Science”. Sci. Eng. Ethics, 15, pp. 375-394.

Rescher, N. 1987. Forbbiden Knowledge. Dordrecht: Reidel.

Singer, P. 1996. “Ethics and the Limits of Scientific Freedom”. The Monist, 79(2), pp. 218-229.

Smith, D.H. 1978. “Scientific Knowledge and Forbidden Truths”. The Hastings Center Report, Vol. 8, No. 6, pp. 30-35.Suárez, M. 2021. “Los límites de la investigación científica”. The Objective, Zibaldone del 16 de octubre.