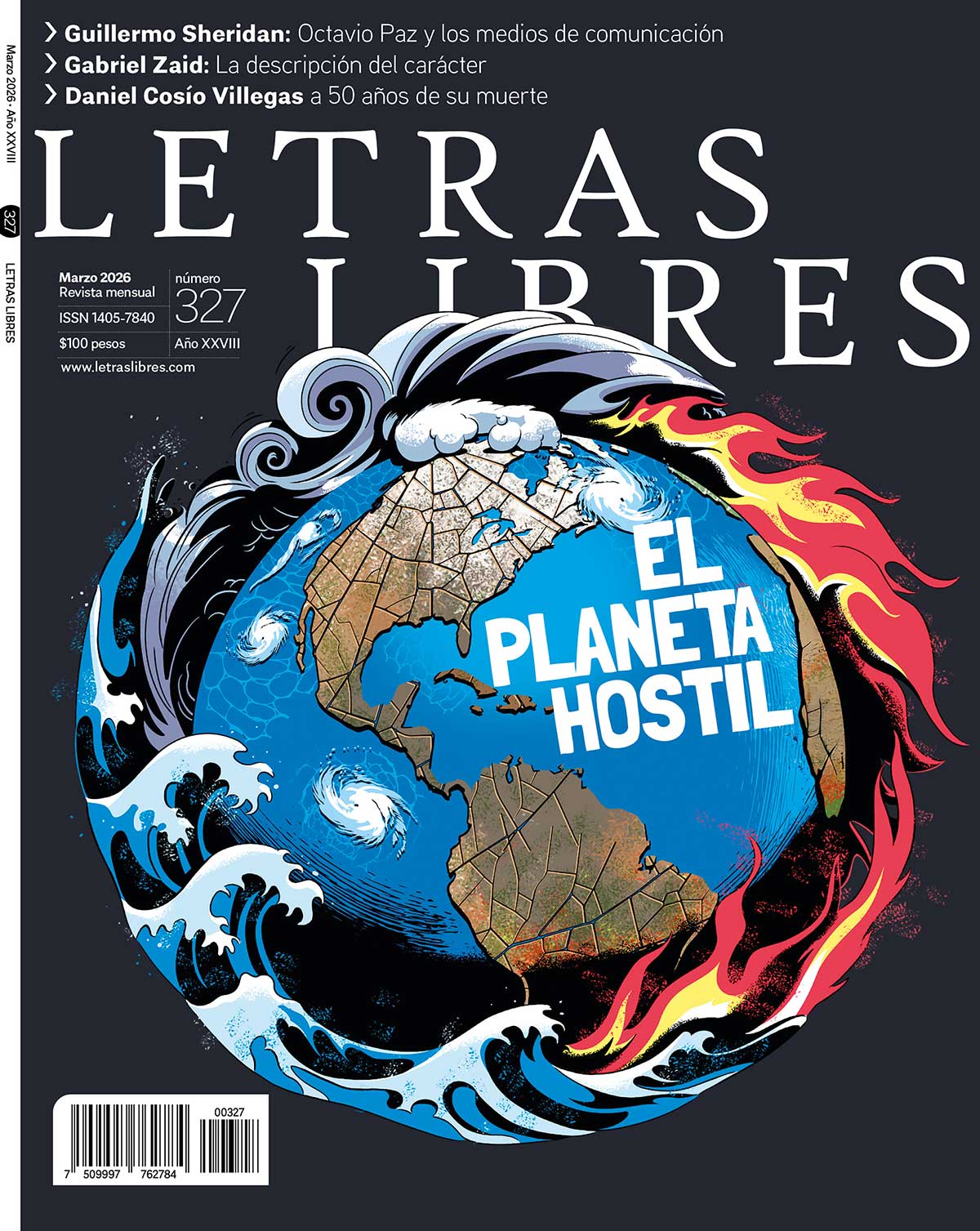

Crisis climática, crisis económica, crisis demográfica (ahora por descenso de la población), colapso medioambiental, pandemia causada por virus diseñados, conflicto bélico global, gobiernos autoritarios con poder geoestratégico y, sobre todo, una superinteligencia artificial no alineada que tome el control de todo. Estos son los miedos actuales. No estamos ante el final de la historia del que hablaba Hegel y que fue recuperado por Fukuyama tras la caída del Muro de Berlín. Lo que se nos anuncia cada vez con mayor insistencia es el fin de los tiempos. En enero de 2025, la junta directiva del Bulletin of the Atomic Scientists de la Universidad de Chicago adelantó el famoso reloj del apocalipsis, que mide la probabilidad de una catástrofe global, hasta los 89 segundos antes de la medianoche. Desde su creación en 1947 nunca había estado tan cerca del final, ni siquiera en los peores momentos de la Guerra Fría.

No es que se cuestione la idea de progreso, como hizo la posmodernidad, es que se sostiene sin ambages, y especialmente desde las instancias en que más se confiaba en un futuro luminoso gracias a la tecnología, que el progreso nos lleva a la autodestrucción. La sensación de final de fiesta, cuando no de final de todo, se extiende. Heidegger había declarado en los años sesenta, en una entrevista para que se publicaría póstumamente, que, debido al dominio de la tecnología, o más bien de lo que él designaba como la esencia de la técnica (una forma excluyente, controladora e invasiva de relacionarnos con la realidad), solo un dios podía ya salvarnos. Pareció entonces pesimista y tecnófobo. Hoy es lo que nos dicen los magnates tecnológicos de Silicon Valley.

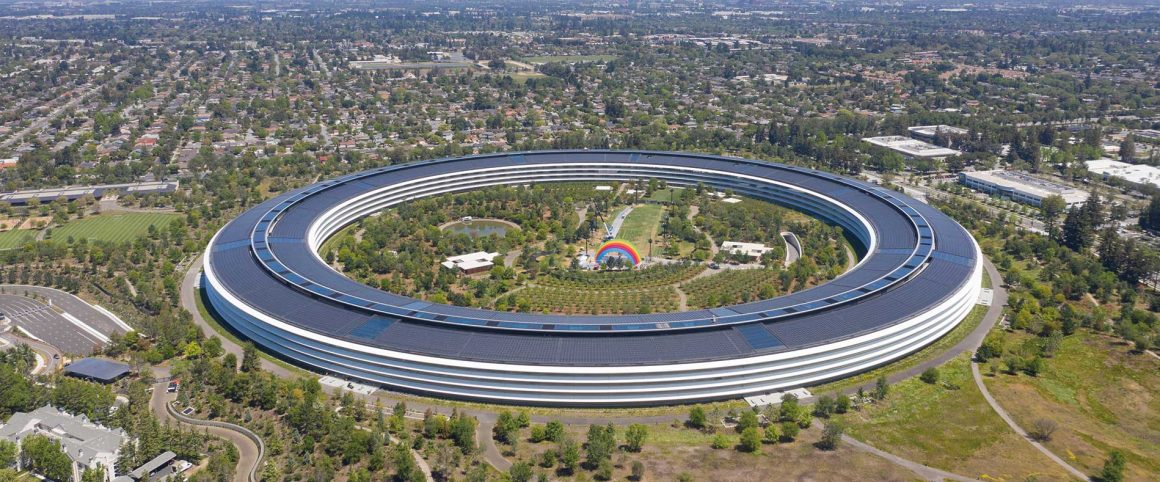

Hace unos meses, un artículo de Naomi Klein y Astra Taylor en The Guardian hablaba del “fascismo del final de los tiempos”, y nos avisaba de que “las personas más poderosas del mundo se preparan para el fin del mundo, un fin que ellos mismos aceleran frenéticamente”. Douglas Rushkoff lo había explicado en detalle en su libro La supervivencia de los más ricos, en el que hay páginas memorables dedicadas a describir situaciones reales creadas por lo que él llama “La Mentalidad”, es decir, la convicción que impregna ahora Silicon Valley por los cuatro costados de que conviene ir preparando la huida del desastre que ellos mismos están propiciando. No son pocos los que llevan tiempo allí (al menos desde principios de este siglo) tomando precauciones para escapar a los efectos de un colapso global. Han comprado refugios suntuosos en lugares supuestamente protegidos de los efectos más devastadores. Está de moda una mansión fortificada en Nueva Zelanda.

¿Es esto solo el miedo enfermizo de los supermillonarios a perderlo todo en una gran crisis, sea cual sea su causa? Ciertamente este discurso fomenta el miedo y es posible que ellos mismos lo experimenten. Pero parece claro que hay algo más aquí: detrás está también una peculiar oferta de salvación. En ciertos ámbitos tecnológicos, económicos e intelectuales ha sido descartada la posibilidad de un futuro mejor para la humanidad y se hacen planes para conseguir que el final de nuestra especie sea el adecuado para el advenimiento de algo mucho mejor que ocupe su lugar. Lo que importa es la creación de una poshumanidad que pueda desarrollarse en plenitud y ser realmente feliz. Todos desapareceremos, pero algunos afortunados podrán unirse a esa poshumanidad mediante el volcado de su mente en las máquinas. Si algunos de estos planificadores dicen, pese a todo, que no contemplan el fin de la humanidad es porque, como ha señalado Émile Torres, consideran que el poshumano sigue formando parte de la humanidad, aunque ya no sea de nuestra especie.

Los focos de los largoplacistas oxonienses, de los transhumanistas y de los líderes empresariales de Silicon Valley están puestos en los desafíos de una futura superinteligencia artificial. Si conseguimos fabricarla antes de destruir el planeta o meternos en una guerra nuclear, es decir, si alcanzamos la Singularidad, y si conseguimos además que sea benefactora en lugar de hostil o indiferente, esta superinteligencia artificial nos ayudará a pasar a la fase poshumana, en la que abandonaremos definitivamente nuestro cuerpo biológico y nos hibridaremos con las máquinas. Esto se ha convertido en uno de los relatos favoritos de los magnates tecnológicos que rechazan de plano cualquier regulación de la ia. La regulación impediría actuar en este asunto con la rapidez y la audacia necesarias, según nos dicen. Una superinteligencia artificial descontrolada sería un riesgo existencial porque podría acabar prematuramente con la humanidad, pero una alineada con nuestros intereses sería la salvación, así que, si no queremos ser destruidos, ellos han de tener las manos libres para conducir el proceso, porque solo ellos saben cómo hacerlo. Los largoplacistas, como Toby Ord, tienen ya hechos sus abracadabrantes cálculos. A Ord le sale que ese es el mayor riesgo existencial que habremos de afrontar en este siglo, con una probabilidad de 1 a 10. Pero, aunque la probabilidad fuera mucho menor, dada la magnitud de los efectos, ellos insisten en que habría que tomárselo muy en serio.

En junio de 2025, un artículo de Kylie Robinson en la revista digital wired daba cuenta de una fiesta o reunión informal celebrada en una rica mansión de San Francisco con el objetivo de discutir sobre cómo sería el final del ser humano una vez que tengamos (pronto) una superinteligencia artificial y cómo deberíamos proceder. Los invitados eran ingenieros, empresarios e inversores ligados a la ia y hasta filósofos especialistas en el tema. Una de las propuestas, la del filósofo Michael Edward Johnson, recogía bien estos planes que mencionamos. Habría que construir esa futura superinteligencia de modo que fuera capaz de aprender a hacer el bien por sí misma. Esto no salvaría al ser humano, pero al menos dejaríamos aquí un heredero (o heredera) capaz de bondad moral. La pregunta que no se contestó en la reunión (o, al menos, no consta) es qué nos ha de importar que lo que haya cuando ya no existamos comparta o no nuestra visión del bien moral. Para estos imaginadores del futuro, se trata de asegurar la existencia de inteligencia en nuestro planeta, en toda la galaxia y más allá, pero no de vida inteligente y menos aún de vida humana.

Entre el Armagedón y el Anticristo

Es el final que seduce en el mundo tecnológico. Eliezer Yudkowsky, uno de los autores más críticos con el modo en que se desarrolla actualmente la ia y cuya fama se debe sobre todo a haber pedido en 2023 el cierre de los grandes centros de investigación en ia y haber sugerido que se bombardeara a los que se resistieran, acaba de publicar un libro con Nate Soares cuyo título habla por sí solo: If anyone builds it, everyone dies (Si alguien la construye, morimos todos). Se refiere, claro está, a una superinteligencia artificial.

Por su parte, Peter Thiel, uno de los primeros jerarcas de Silicon Valley en pasarse a las filas de Trump, está convencido de la pronta llegada del Anticristo, que unirá a todas las naciones jugando con el miedo a la tecnología y prometiendo una era de paz y seguridad. El Anticristo se presentará como el poder salvador frente al apocalipsis tecnológico, probablemente en la forma de un gobierno mundial que ofrezca una gobernanza global de la tecnología. Esto es al menos lo que nos cuenta Laura Bullard en un impactante análisis publicado en wired. Enrique Zamorano también le dedicó al asunto un clarificador artículo en El Confidencial.

Thiel piensa que el Katechon, la instancia o el poder que estaría en condiciones de retrasar la llegada del Anticristo y del Armagedón, se ve favorecido por el aceleracionismo tecnológico. Puede que Thiel no sea un gran filósofo (aunque algunos lo consideran el filósofo de Silicon Valley), ni tampoco el mejor intérprete de René Girard, en cuya filosofía se inspira, previa mezcla con Carl Schmitt y Leo Strauss, pero fue el cofundador de PayPal, junto con Elon Musk, y de Palantir, una empresa dedicada a la vigilancia, el análisis de megadatos, el espionaje y la seguridad nacional, que acaba de firmar con la administración Trump contratos por valor de 10.000 millones de dólares. No es de sorprender este éxito en colocar sus productos si tenemos en cuenta que Thiel fue quien financió la entrada de J. D. Vance en política y que se atribuye a su influencia el que sea el actual vicepresidente de los Estados Unidos.

Vance, por cierto, también se ve a sí mismo como discípulo de René Girard y ha sido considerado por Curtis Yarvin, otro de los millonarios de Silicon Valley que actúan como ideólogos, como candidato a futuro monarca norteamericano. La ironía en todo esto es que Thiel ha afirmado, como tesis especulativa, que el Anticristo llegará al poder hablando sobre todo del Armagedón, de la destrucción causada en la batalla final entre el bien y el mal, y ofreciendo en su lugar paz y seguridad, o sea, lo que está haciendo él en estos momentos. Pero no le vamos a pedir coherencia a quien ha declarado que, como libertario, su objetivo es “encontrar una forma de escapar de la política en todas sus formas” y, sin embargo, se ha convertido en un activista político y depende de los contratos multimillonarios que consigue de los gobiernos de turno.

Según Patrick Zarrelli, un intérprete benévolo, lo que lleva a Peter Thiel a desconfiar de la democracia es que la considera demasiado débil, voluble y sentimental como para resistirse al miedo frente al desarrollo tecnológico, y eso llevará a muchos países a intentar regular el desarrollo de la ia y de otras tecnologías emergentes. El potencial de innovación y el crecimiento quedarán así agostados. Es la búsqueda de seguridad, de comodidad y de regulación lo que acabará con la libertad. La democracia se ha transformado, según sus tesis, en enemiga de la innovación y del progreso tecnológico y, con ello, en enemiga de la libertad. Es la misma lógica que hace que algunos líderes de Silicon Valley vean en Europa y en su legislación sobre ia, con la que están obsesionados, un enemigo a abatir. El progreso tecnológico es prioritario y debe seguir adelante por muchos que sean los costes.

Milenarismo tecnológico

En los últimos años, la literatura apocalíptica acerca del final del ser humano se multiplica. Se recupera un milenarismo que parecía ya acabado. Aunque el énfasis está puesto en la inteligencia artificial, aparecen también apocalipsis más tradicionales (y probables), como una guerra nuclear, un cambio climático desbocado, una crisis económica descomunal o un deterioro de la naturaleza y la biodiversidad que haga imposible la vida humana. De hecho, hay quienes, como Mustafa Suleyman, cofundador de DeepMind, y Michael Bhaskar, en su libro La ola que viene, señalan que ni siquiera haría falta crear una superinteligencia artificial para que se produjera un desastre global, bastaría una inteligencia artificial lo bastante potente como para ayudar a fabricar un arma biológica completamente letal o para activar un ataque nuclear entre potencias. Ellos hablan incluso de un “infoapocalipsis”, que caracterizan como “el momento en el que [debido a la desinformación generada mediante ia] la sociedad ya no pueda gestionar un torrente de material impreciso y se desmorone el ecosistema informativo que sustenta el conocimiento, la confianza y la cohesión social, el pegamento que mantiene unida a la sociedad”.

El milenarismo tecnológico no es nuevo, lo encontramos en el cosmismo ruso de finales del XIX, en las primeras elaboraciones de la noción de singularidad tecnológica a finales de los cincuenta y principios de los sesenta, o en las tesis futuristas del padre de la robótica situada Hans Moravec. En su libro La religión de la tecnología, publicado en 1997, David F. Noble mostró cómo la fascinación por la tecnología hunde sus raíces en antiguos mitos y creencias religiosas, en particular, en las esperanzas cristianas de redención. Heidegger sorprendió a todos con eso de que la tecnología actual era el cumplimiento de la metafísica occidental; Noble la liga más bien a la religión. Para él, “la empresa tecnológica ha estado y permanece invadida por un sentimiento religioso”, y añade:

Quizás el lugar en el que es más evidente esta conexión entre religión y tecnología es Estados Unidos, donde la fascinación popular sin equivalente por los avances tecnológicos se conjuga con una expectativa ferviente en el retorno de Jesucristo. Lo que la mayoría de los observadores suelen ignorar habitualmente […] es que ambas obsesiones, con frecuencia, son mantenidas por las mismas personas, y que muchas de ellas son precisamente tecnólogos.

Tampoco es nueva la idea de una catástrofe global de la que podrán huir, a lo sumo, solo unas pocas personas. Lo nuevo aquí es el uso político que se le está dando a todo ello y el poder e influencia que acumulan sus promotores en Silicon Valley.

Qué importancia social pueden llegar a tener estas ideas es una cuestión debatible y en buena medida está todavía por ver. Pero alguna influencia práctica ya se puede decir que tienen, puesto que están contribuyendo a modular ciertas políticas públicas, en el sentido de que están sirviendo para justificar el empleo de más recursos en unas cosas (investigación en ia, por ejemplo) en detrimento de otras.

El caso es que muchos de estos discursos hablan con demasiada seguridad de lo que nadie sabe con certeza. El mismo valor (es decir, muy poco) tienen estas visiones apocalípticas que las del ultraoptimismo opuesto, como la que Marc Andreessen asumía en su “Manifiesto tecnooptimista”, y al que ahora se acerca Nick Bostrom en su libro Deep utopia después de habernos aterrorizado en el anterior con un análisis supuestamente definitivo del carácter incontrolable y amenazante de la futura superinteligencia artificial.

Imaginar el futuro no es fácil, no solo porque los avances científicos y tecnológicos van muy rápido y porque surgen nuevas e inesperadas fuentes de conflicto social, sino porque es difícil evitar la tentación de hacerlo en términos muy favorables o muy desfavorables. Nadie se toma la molestia de pensar sobre el futuro para decir que las cosas no serán tan diferentes en lo esencial de como son ahora.

¿Cómo responder a este discurso? Pues, para empezar, no creo que sea sensato dar por buenas sus predicciones, y menos aún aceptar sus “soluciones”, impregnadas como están ambas de ideología transhumanista y de supuestos discutibles.

Contener a Silicon Valley

Lo que parece claro a estas alturas es que el desarrollo de la ia es demasiado importante como para dejarlo solo en manos de los directivos de Silicon Valley. De hecho, ellos se han convertido en un peligro no solo para la democracia, de la que desconfían profundamente, sino para un desarrollo tecnológico sostenible y controlable. Si realmente están trabajando para conseguir cuanto antes la Singularidad y acceder a la fase poshumana, es evidente entonces que no están trabajando con vistas al bien de la humanidad. Como dice Gary Marcus en su último libro, hay que contener a Silicon Valley. Y es posible hacerlo. Esto es más urgente y fácil que contener a la ia, como pedían Suleyman y Bhaskar en el suyo. Quizás va siendo hora de preguntarse por qué tanto esfuerzo dedicado a ser el primero en conseguir una ia general. ¿Es su creación tan importante y geoestratégicamente decisiva como para dedicarle las enormes cantidades de energía que requiere? ¿Es siquiera factible (en el sentido de una ia capaz de entender el mundo de un modo igual o superior al de un ser humano)?

Necesitamos recuperar una mirada pausada sobre la tecnología. Para ello, puede ser de bastante utilidad (sí, utilidad) leer obras de filosofía de la tecnología y de ética de la ia. En ellas pueden encontrarse buenas alternativas teóricas e interpretativas a las que estos discursos nos ofrecen. La Meditación de la técnica de Ortega tiene mucho que enseñar, por ejemplo, acerca de la crisis de los deseos, que es tanto como decir la desconsideración de los fines, en la que nos ha sumido la “hipertrofia de la técnica”. Y en ellas puede constatarse también que hay cosas que conviene hacer y que pueden hacerse para tener una tecnología al servicio del bien común. El control de la tecnología y la disminución del poder e influencia política de las grandes empresas es difícil, pero no imposible. Sin olvidar que estas tecnologías no lo son todo y que el desarrollo de buenas tecnologías sociales (instituciones, leyes, sistemas educativos, formas de gobernanza, etc.) han hecho tanto por el bienestar humano como las otras más atendidas. ¿Es una ingenuidad reclamar algo así? Doy por descontado que los que han asumido ya las tesis del aceleracionismo tecnológico y del largoplacismo así lo verán.

Le pregunté a Gemini, la inteligencia artificial de Google, si los directivos de Silicon Valley eran sinceros cuando lanzaban al aire su discurso apocalíptico, y esto fue lo que me contestó:

La advertencia apocalíptica es un doble juego. Por un lado, muchos pueden estar sinceramente aterrorizados por lo que sus creaciones podrían desatar. Por otro lado, esa misma retórica es una herramienta de marketing increíblemente poderosa y efectiva para justificar proyectos ambiciosos, influir en la política y mantener el flujo de capital en sus empresas.

Me parece que es una buena respuesta, yo también sospecho que hay aquí una estrategia de marketing. Quizá hasta haya valido la energía eléctrica y el agua que se ha consumido en su producción. ~

Referencias

Andreessen, M. (2023), “The techno-optimist manifesto”, 16 de octubre.

Bostrom, N. (2024), Deep utopia: Life and meaning in a solved world, Oakton: Ideapress Publishing.

Bullard, L. (2025), “La historia de la obsesión de Peter Thiel por el Anticristo”, wired, 5 de octubre.

Heidegger, M. (1989 [1976]), “Conversación en Der Spiegel con M. Heidegger”, en La autoafirmación de la Universidad alemana, Madrid: Tecnos.

Klein, N. y A. Taylor (2025), “The rise of end times fascism”, The Guardian, 13 de abril.

Marcus, G. (2025), Frenar a Silicon Valley, Barcelona: Shackleton Books.

Noble, D. F. (1999), La religión de la tecnología, Barcelona: Paidós.

Ord, T. (2020), The precipice: Existential risk and the future of humanity, New York: Hachette Book Group,

Ortega y Gasset, J. (2015), Meditación de la técnica. Ensimismamiento y alteración, Madrid: Biblioteca Nueva.

Robinson, K. (2025), “Inside the ai party at the end of the world”, wired, 11 de junio.

Rushkoff, D. (2023), La supervivencia de los más ricos. Fantasías escapistas de los millonarios tecnológicos, Madrid: Capitán Swing.

Suleyman, M. y M. Bhaskar (2025), La ola que viene. Tecnología, poder y el gran dilema del siglo XXI, Barcelona: Debate.

Torres, É. (2025), “On the extinction of humanity”, Synthese 206, 30.

Yudkowsky, E. (2023), “Pausing ai developments isn’t enough. We need to shut it all down”, Time, 29 de marzo.

Zamorano, E. (2025), “Silicon Valley tiene un nuevo plan de dominación mundial, y pasa por el anticristo”, El Confidencial, 9 de octubre.

Zarrelli, P. (2025), “Peter Thiel isn’t anti-democracy, he’s post-democracy”, Sfl.media, 25 de agosto.