Hay muy buenas razones para temer que los sistemas de inteligencia artificial (IA) como ChatGPT y GPT4 perjudiquen a la democracia. El debate público puede verse desbordado por cantidades industriales de discusiones autogeneradas. Las personas podrían caer en madrigueras de conejo políticas, atraídas por patrañas superficialmente convincentes, o enredarse con personalidades inexistentes generadas por máquinas.

Estos riesgos pueden ser la consecuencia de un mundo en el que las empresas, buscando establecer un monopolio, despliegan sistemas de IA poco probados en su lucha por el mercado.

Sin embargo, la distopía no es el único futuro posible. La IA podría promover el bien público, no las ganancias privadas, y reforzar la democracia en lugar de socavarla. Esto requeriría una IA que no estuviera bajo el control de un enorme monopolio tecnológico, sino desarrollada por el gobierno y disponible para todos los ciudadanos. Esta opción pública está a nuestro alcance.

Una IA construida para el beneficio público podría ser una excelente opción para aquellos casos en los que la tecnología puede ser de mayor ayuda para la democracia. Podría plausiblemente educar a los ciudadanos, ayudarlos a deliberar juntos, resumir lo que piensan y encontrar posibles puntos en común. Los políticos podrían utilizar grandes modelos lingüísticos, o LLM por sus siglas en inglés, como GPT4 para entender mejor lo que sus ciudadanos desean.

Hoy en día, los sistemas de IA de última generación están controlados por empresas tecnológicas multimillonarias: Google, Meta y OpenAI con Microsoft. Estas empresas deciden cómo nos relacionamos con sus IA y qué tipo de acceso tenemos. Pueden dirigir y moldear dichas IA de acuerdo con sus intereses corporativos. Este no es el mundo que queremos. Más bien, queremos opciones de IA que sean bienes públicos y estén dirigidas al bien público.

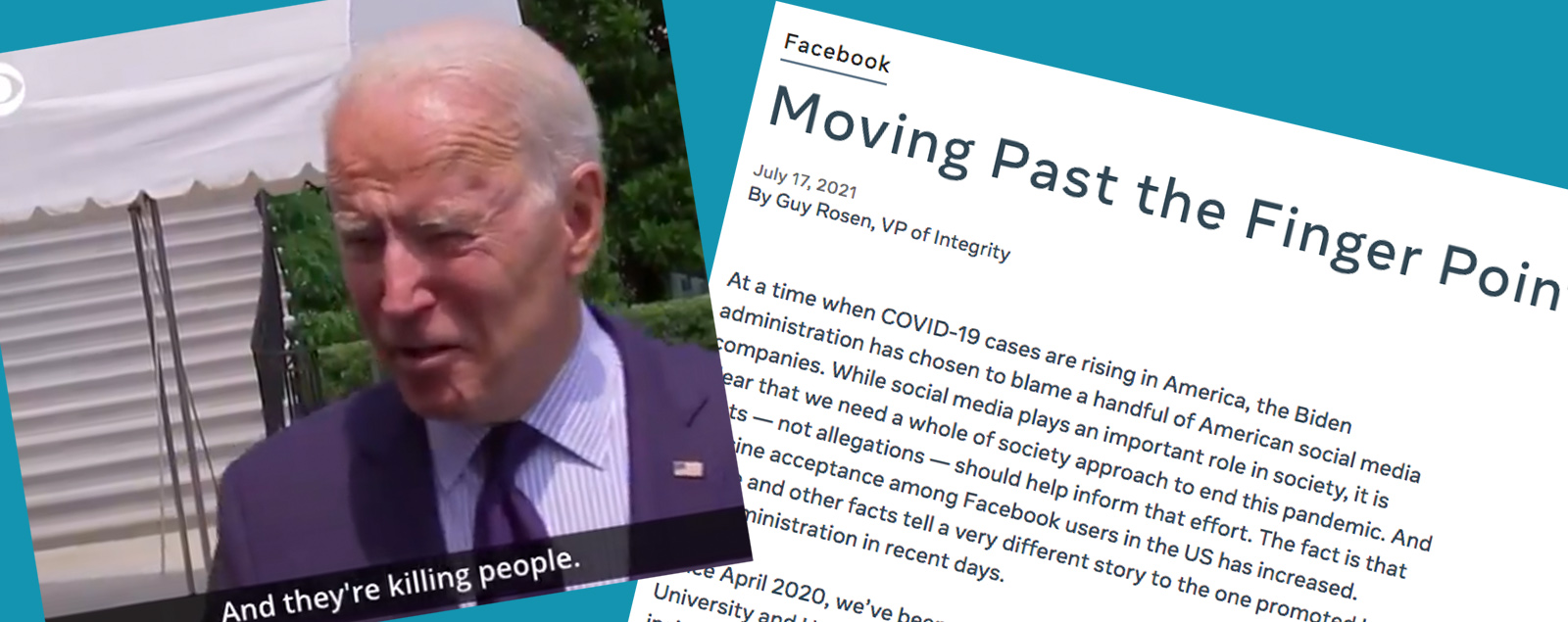

Sabemos que los LLM existentes se entrenan con material recopilado de internet, que puede reflejar sesgos racistas y discursos de odio. Las empresas intentan filtrar estos conjuntos de datos, afinar los LLM y ajustar sus resultados para remover los sesgos y la toxicidad. Pero correos electrónicos y conversaciones filtradas sugieren que se están apresurando a sacar sus productos al mercado en una carrera por establecer su dominio.

Estas empresas toman decisiones que tienen enormes consecuencias para la democracia, pero con escaso control democrático. No nos enteramos de las concesiones políticas que hacen. ¿Acaso los chatbots y motores de búsqueda con tecnología LLM favorecen algunas opiniones sobre otras? ¿Evitan por completo los temas controvertidos? Actualmente, tenemos que confiar ciegamente en que las empresas nos digan la verdad sobre los compromisos a los que se enfrentan.

Una opción pública de LLM proporcionaría una fuente independiente de información vital y un espacio de pruebas para opciones tecnológicas que tienen grandes consecuencias democráticas. Podría funcionar de forma muy parecida a los planes de atención médica pública que aumentan el acceso a los servicios sanitarios mientras que aportan más transparencia a las operaciones del sector y ejercen presión sobre los precios y las características de los productos privados. También nos permitiría conocer los límites de los LLM y orientar sus aplicaciones teniéndolos en cuenta.

Sabemos que los LLM suelen “alucinar”, infiriendo hechos que no son reales. No está claro si se trata de una falla inevitable de la manera en la que operan o si puede corregirse. La democracia podría verse minada si los ciudadanos confían en tecnologías que inventan cosas al azar, y no se puede confiar en que las empresas que intentan vender estás tecnologías admitan sus defectos.

Pero una IA de opción pública podría hacer más que solo comprobar la honestidad de las empresas tecnológicas. Podría examinar nuevas aplicaciones para apoyar la democracia en lugar de dañarla.

Lo más obvio es que los LLM podrían ayudarnos a formular y expresar nuestras perspectivas y posturas políticas, haciendo que los argumentos políticos sean más convincentes e informados, ya sea en redes sociales, en cartas al editor o en los comentarios a los organismos normativos en respuesta a las propuestas políticas. Con esto no nos referimos a que la IA vaya a reemplazar a los humanos en el debate político, sino que puede ayudarnos a expresarnos. Si alguna vez has utilizado una tarjeta de felicitación o firmado una petición, ya has demostrado que estás de acuerdo con aceptar ayuda para articular tus sentimientos personales o tus creencias políticas. La IA va a hacer que sea mucho más fácil generar los primeros borradores, y proveerá ayuda editando y sugiriendo frases alternativas. Las percepciones en torno al uso de estas IA van a cambiar con el tiempo, y aún hay mucho margen de mejora en los LLM, pero su capacidad de asistencia es real. Las personas ya están probando y especulando sobre su potencial para escribir discursos, generar grupos de presión y elaborar mensajes de campaña. Las personas más influyentes suelen depender de redactores de discursos y personal profesional para ayudarles a desarrollar sus ideas, y la IA podría desempeñar un rol similar para los ciudadanos.

Si el problema de la “alucinación” puede resolverse, los LLM también podrían convertirse en explicadores y educadores. Imaginemos que los ciudadanos pudieran consultar a un LLM que tiene conocimientos especializados sobre un tema político, o que dominara las posturas de un candidato o partido concreto. En lugar de tener que analizar declaraciones evasivas calibradas para una audiencia de masas, los ciudadanos podrían obtener un verdadero entendimiento político a través de sesiones de preguntas y respuestas con los LLM, que podrían estar siempre disponibles y ser infinitamente pacientes en situaciones que ningún humano podría serlo jamás.

Finalmente, y de manera más ambiciosa, la IA podría ayudar a facilitar la democracia radical a gran escala. Cosma Shalizi, profesor de estadística en la Universidad Carnegie Mellon, ha observado que delegamos las decisiones en los políticos electos en parte porque no tenemos tiempo para deliberar sobre cada asunto. Pero la IA podría gestionar conversaciones políticas masivas en salas de chat, en redes sociales y en otros espacios, identificando posturas comunes y resumiéndolas, sacando a la luz argumentos inusitados que parezcan convincentes para aquellos que los han escuchado, y manteniendo los ataques e insultos a un mínimo.

Los chatbots de IA podrían organizar asambleas ciudadanas nacionales de manera electrónica y automáticamente resumir las perspectivas de los diversos participantes. Este tipo de debate cívico moderado por la IA podría ser también una alternativa dinámica a las encuestas de opinión. Los políticos recurren a los sondeos de opinión para captar imágenes de la opinión popular porque ellos solo pueden escuchar directamente a un pequeño número de votantes, pero quieren entender en qué están de acuerdo o no en su conjunto.

De cara al futuro, estas tecnologías podrían ayudar a los grupos a llegar a consensos y tomar decisiones. Los primeros experimentos de la empresa de IA DeepMind sugieren que los LLM puedan construir puentes entre personas que están en desacuerdo, ayudándolas a llegar a un consenso. En su maravillosa novela A half-built garden, la escritora de ciencia ficción Ruthanna Emrys imagina de qué forma la IA podría ayudar a las personas a mantener mejores conversaciones y tomar mejores decisiones, en lugar de aprovecharse de los sesgos para maximizar sus ganancias.

Este futuro requiere de una opción pública de IA. Construirla, a través de un programa de desarrollo y despliegue de modelos dirigidos por un gobierno, requerirá un gran esfuerzo y los mayores retos en el desarrollo de sistemas públicos de IA serían políticos.

Algunas herramientas tecnológicas ya están disponibles para el público. De hecho, gigantes tecnológicos como Google y Meta llevan años poniendo a disposición del mismo muchas de sus últimas y mejores herramientas de IA, en cooperación con la comunidad académica. Aunque OpenAI no ha hecho público su código fuente ni las características entrenadas de sus últimos modelos, competidores como Hugging Face sí lo han hecho para sistemas similares.

Aunque los LLM más avanzados logran resultados espectaculares, lo hacen usando técnicas que, en su mayoría, son ampliamente conocidas y usadas en todo el sector. OpenAI únicamente ha revelado detalles limitados sobre cómo entrenó a su último modelo, pero su mayor avance con respecto a su anterior modelo ChatGPT no es ningún secreto: un proceso de entrenamiento multimodal que acepta entradas tanto de imágenes como de texto.

Los LLM de mayor alcance que se forman hoy en día cuestan cientos de millones de dólares. Eso está fuera del alcance de las personas ordinarias, pero es insignificante si se le compara con el gasto militar federal de Estados Unidos –y es una ganga, pensando en los retornos que puede generar. Aunque no queramos expandir a las agencias existentes para emprender esta tarea, en Estados Unidos existen laboratorios gubernamentales, como el Instituto Nacional de Estándares y Tecnología , el Laboratorio Nacional Lawrence Livermore y otros laboratorios del Departamento de Energía , así como universidades y organizaciones sin fines de lucro, con la experiencia y capacidad en IA para supervisar este esfuerzo.

En lugar de lanzar sistemas de IA a medio terminar para que el público los pruebe, necesitamos garantizar que son sólidos antes de estrenarlos, y que fortalecen la democracia en lugar de perjudicarla. El avance clave que ha hecho que los últimos modelos de chabot de IA sean mucho más útiles ha sido la retroalimentación de personas reales. Las empresas contratan equipos para interactuar con las primeras versiones de su software y enseñarles cuáles resultados son útiles y cuáles no. Estos usuarios pagados entrenan a los modelos para que se alineen con los intereses corporativos, pensando en aplicaciones como la búsqueda web (que integra anuncios comerciales) y el desarrollo de software auxiliar para la productividad empresarial.

Para construir una IA de asistencia para la democracia, tendríamos que capturar la respuesta humana para casos de uso democrático específicos, como moderar un debate político polarizado, explicar los matices en una propuesta legal o articular una perspectiva propia dentro de un debate más amplio. Esto nos da un camino para “alinear” los LLM con nuestros valores democráticos: tener modelos que generan respuestas a preguntas, cometan errores, y aprendan de las respuestas de usuarios humanos, sin permitir que estos errores perjudiquen a los usuarios generales y al ámbito público.

Lograr este tipo de interacción y retroalimentación de los usuarios dentro de un entorno político que desconfía tanto de la IA como de la tecnología en general será un desafío. Es fácil imaginar que los mismos políticos que critican la falta de fiabilidad de empresas como Meta se irriten mucho más ante la idea de que el gobierno desempeñe un papel en el desarrollo tecnológico.

Como dijo Karl Popper, el gran teórico de la sociedad abierta, no deberíamos intentar solucionar problemas complejos con grandes planes llenos de arrogancia. Más bien, deberíamos aplicar la IA mediante una ingeniería democrática concienzuda, determinando cautelosamente lo que funciona y lo que no. La mejor manera de avanzar es empezar paulatinamente, aplicando estas tecnologías a decisiones locales con grupos de partes interesadas más limitados y con menor impacto.

La próxima generación de experimentos con IA debería tener lugar en los laboratorios de la democracia: los estados y los municipios. Las asambleas en línea para debatir propuestas de presupuestos participativos locales podrían ser un primer paso más sencillo. Los LLM disponibles en el mercado y de código abierto podrían impulsar este proceso y crear un empuje hacia la inversión federal en una opción de IA pública.

Incluso con estos planteamientos, construir y poner en marcha una opción de inteligencia artificial democrática será complicado y difícil. Sin embargo, la alternativa –encogernos de hombros mientras la lucha por el dominio de la inteligencia artificial comercial deteriora la política democrática– será mucho más complicada y mucho peor. ~

Este artículo es publicado gracias a una colaboración de Letras Libres con Future Tense, un proyecto de Slate, New America, y Arizona State University.