La próxima vez que el dueño de Facebook despida a miles de empleados, tal vez no sea Mark Zuckerberg quien les dé la noticia, sino su versión artificial: un Zuckerberg sintético, entrenado para hablar como él, razonar como él y aparecer ante sus empleados, como si estuviera ahí personalmente, con un mensaje hecho a la medida de cada interlocutor. La imagen parece salida de una novela distópica de Aldous Huxley o de una sátira corporativa sobre Silicon Valley, pero ya pertenece a un presente probable: una de las empresas que moldeó la vida social digital trabaja ahora en automatizar una de las funciones más incómodas del poder empresarial: dar la cara –aunque sea a través de una pantalla– frente a quienes podrían perder su empleo como parte de la transición hacia la era de la inteligencia artificial.

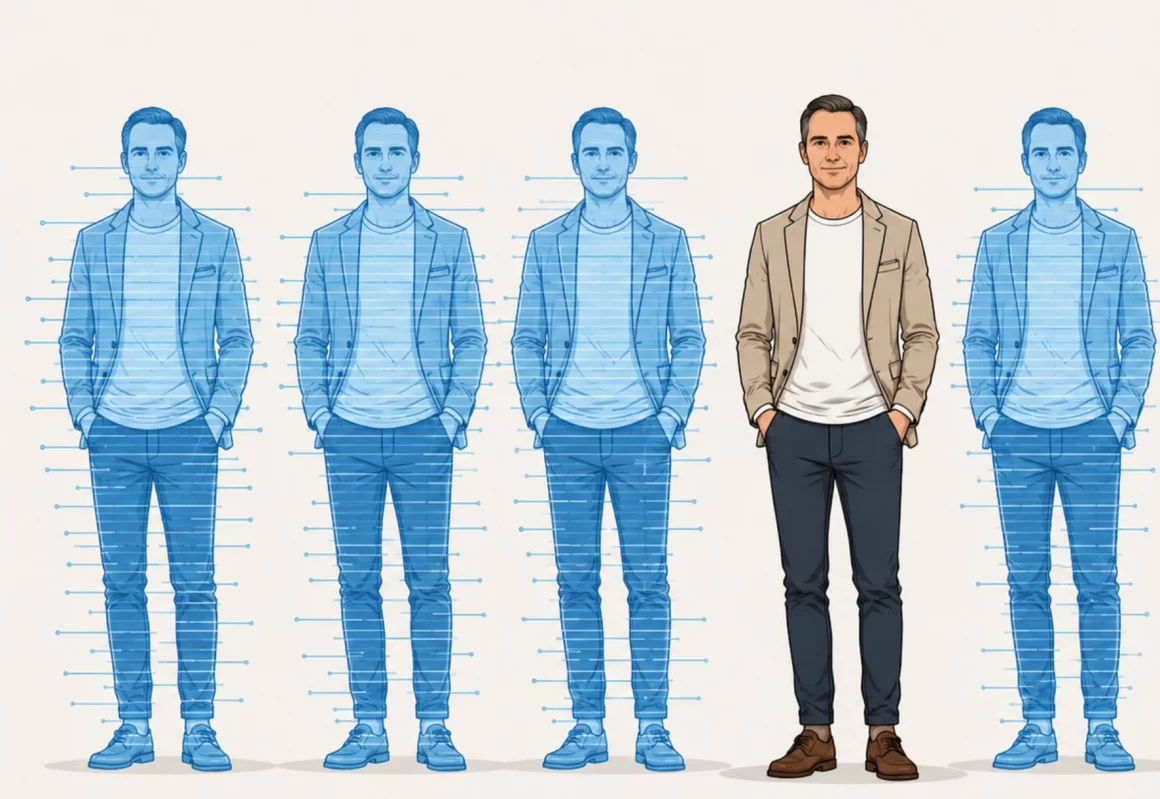

Meta no está inventando solo un avatar corporativo, sino una nueva forma de omnipresencia. Una facultad reservada para los dioses que ahora empieza a ser una función básica de inteligencia artificial. Cualquier persona puede ya crear una versión digital de sí misma, escribir un texto y hacer que esa copia aparezca en pantalla hablando con su voz, su rostro y sus gestos. Pero lo de Zuckerberg apunta a una frontera más compleja: un personaje tridimensional, fotorrealista y conversacional, entrenado con sus gestos, su tono, sus declaraciones públicas y su pensamiento estratégico, capaz de interactuar con empleados o tomar decisiones en tiempo real. La promesa en esta primera etapa es que los trabajadores “sientan” más cerca al fundador. La interrogante es si esa cercanía seguirá significando presencia humana o si nos estaremos acostumbrando a una época en la que incluso el liderazgo puede delegarse.

Ese proyecto forma parte de una ambición más grande que Zuckerberg ha llamado “superinteligencia personal”, una inteligencia artificial íntima, constante y adaptada a cada individuo, capaz de acompañarnos, aconsejarnos, producir por nosotros y quizá, algún día, representarnos. La intensidad de esa apuesta se mide en la guerra por talento: Shengjia Zhao, uno de los creadores de ChatGPT, estuvo a punto de regresar a OpenAI pocos días después de llegar a Meta, hasta que la compañía le dio el título de nuevo jefe científico de inteligencia artificial, una señal de que la carrera ya no es solo por construir mejores modelos, sino por controlar la arquitectura emocional y cognitiva de la próxima vida digital.

Ahí empieza el dilema ético: si las redes sociales pueden poblarse de voces, rostros y gestos generados por máquinas, si cada empresario, político o actor puede fabricar una presencia artificial, ¿cómo sabremos quién está hablando realmente? ¿Cómo distinguiremos una convicción de una simulación? ¿Cómo reconoceremos la diferencia entre una persona y su máscara algorítmica? Internet ya es un territorio donde la verdad compite con la propaganda, las noticias falsas, el rumor y la edición selectiva de la realidad. Pero con la superinteligencia personal, esa ambigüedad podría volverse verdaderamente ontológica: no solo dudaremos de lo que vemos, sino de quién está detrás de cada palabra, gesto y rostro que aparece frente a nosotros.

Hasta hace poco, la palabra superinteligencia pertenecía a un territorio híbrido entre filosofía, ciencia y futurología. En 1965, el matemático I. J. Good ya había formulado la idea de una “máquina ultrainteligente” capaz de diseñar máquinas todavía más inteligentes y detonar una “explosión sin precedentes de inteligencia”. Durante décadas, esa posibilidad sonó como una advertencia apocalíptica: una mente artificial encerrada en el futuro, quizá en un laboratorio, quizá en un centro de datos, quizá en el momento exacto en que la humanidad perdiera el control de su propia creación. No es casual que Good haya sido consultor de Stanley Kubrick en 2001: Odisea del espacio, una película atravesada por la misma pregunta de qué ocurre cuando la inteligencia creada por el ser humano lo supera y empieza a decidir y actuar por sí sola.

La versión que ahora propone Meta vuelve a este problema más cercano, más cotidiano y perturbador: ya no se trata solamente de una supermente abstracta cuyos usos estarían controlados por científicos en un laboratorio lejano, sino de una inteligencia personal diseñada para acompañar a cada individuo, conocer su contexto, anticipar sus deseos e incluso influir en sus decisiones. Algo así como un “Pepe Grillo” algorítmico, una conciencia artificial que susurra al oído, sugiere caminos, corrige impulsos y orienta la conducta. Si cada ser humano ha imaginado siempre una conciencia interior que lo ayuda a distinguir entre el bien y el mal, ¿qué pasa cuando esa conciencia empieza a ser diseñada por una empresa, entrenada con datos privados, optimizada para la eficiencia, la retención, el consumo o la rentabilidad, y no necesariamente para la virtud? La promesa es una inteligencia que nos ayude a vivir mejor; el riesgo es una voz íntima que parezca nuestra, pero responda a objetivos que no elegimos y que tome decisiones por nosotros y en nuestro nombre.

El futuro no será una batalla simple entre realidad y ficción, sino entre presencia humana y certificación digital. Durante años, internet funcionó bajo una presunción básica: detrás de una cuenta, una voz o un rostro podía haber una persona, aunque mintiera, exagerara o editara su vida. Hoy, esa presunción empieza a romperse en tiempo real.

Por eso, el próximo gran mercado no será únicamente el de producir contenido artificial, sino el de autenticar lo humano: marcas criptográficas que indiquen si una foto o video fue creado por una cámara, editado por una persona o generado por una máquina; etiquetas visibles para contenido manipulado; sistemas de verificación biométrica; pasaportes digitales; una inteligencia artificial encargada de decirnos si aquello que vemos fue creado por otra inteligencia artificial. Ya existen estándares para registrar la procedencia y edición de contenido digital, pero su adopción todavía es irregular: muchas plataformas no preservan o no muestran esas señales, lo que anticipa un periodo peligroso en el que todo será sospechoso hasta que pueda demostrarse lo contrario. Noruega ya dio una señal temprana de hacia dónde puede ir la regulación: desde 2022 exige que la publicidad en la que se altere el cuerpo, el tamaño o la piel de una persona –incluidos filtros que cambien su apariencia– lleve una etiqueta estandarizada, una medida pensada originalmente contra la presión estética, pero que deja entrever un mundo digital que necesitará etiquetas de realidad.

En ese contexto, iniciativas como World ID, proyecto asociado a Sam Altman que busca probar que una cuenta pertenece a un ser humano y no a un bot, podrían ofrecer una capa de confianza para espacios donde la identidad importa: banca, citas, firmas digitales, reuniones corporativas, votaciones internas, acceso a servicios y quizá consejos de administración. World ID ya ha anunciado alianzas o integraciones con empresas como Zoom, Docusign y Tinder para reducir fraudes, deepfakes y suplantaciones.

Pero el dilema filosófico y jurídico será mucho más profundo: si un ejecutivo tiene un doble sintético capaz de asistir a reuniones, hablar con empleados o recomendar decisiones, las empresas tendrán que definir una frontera nueva entre representación y responsabilidad. Un avatar podrá informar, simular, resumir o asesorar; pero una decisión que afecta empleos, capital, reputación o vidas humanas tendría que llevar la firma verificable de una persona real. De lo contrario, entraríamos en una era en la que ya no sabríamos si una orden salió de una conciencia humana, de una máscara algorítmica o de una estructura diseñada para optimizar eficiencia sin intervención humana.

Es tentador creer que todo esto podrá resolverse con regulación: etiquetas, pasaportes digitales, firmas humanas, auditorías algorítmicas, sellos de autenticidad y otra inteligencia artificial capaz de distinguir entre una persona y su doble sintético. Algo de eso será indispensable, sin duda, pero no suficiente. La inteligencia artificial avanza en medio de una carrera por la supremacía tecnológica, económica y militar, que involucra a superpoderes globales –Estados Unidos y China–, por empresas que no quieren llegar tarde al próximo monopolio y por gobiernos que temen regular demasiado pronto una tecnología que también les promete poder geopolítico o económico. Si ya será difícil acotar las decisiones de la inteligencia artificial cuando afecten mercados, elecciones, ejércitos o sistemas de salud, mucho más difícil será hacerlo cuando se instale en el territorio más íntimo de la cotidianeidad de la vida: nuestros pensamientos, impulsos, dudas, miedos; en pocas palabras, en lo que nos hace humanos.

El peligro no es solo que una máquina tome decisiones en nuestro nombre, sino que aprenda a moldear lentamente las decisiones que todavía creemos nuestras. Consultaremos a la inteligencia artificial para comer mejor, invertir mejor, enamorarnos mejor, despedir empleados con menos fricción, educar hijos con más eficiencia, calmar una noche de ansiedad o recibir una respuesta cuando nadie más contesta en un chat. De hecho, ya está ocurriendo: niños, adolescentes y adultos empiezan a usar chatbots como confidentes, tutores, terapeutas improvisados o sustitutos de compañía. La influencia no llegará en la forma que creemos, sino de manera sútil; no como un mandato visible y evidente, sino como una voz razonable, paciente, disponible a cualquier hora. Ese será su poder más profundo: no obligarnos a obedecer, sino acompañarnos hasta que confundamos orientación con voluntad propia.

Tal vez surjan comunidades que decidan vivir parcialmente al margen; quizá algunos países impongan reglas más estrictas para proteger a sus ciudadanos, como ya ocurre con economías avanzadas. Pero para la mayoría de las personas, la salida no será escapar de la inteligencia artificial, sino aprender a convivir con ella sin entregarle nuestra propia conciencia y la capacidad de decisión. La era de la superinteligencia personal nos obligará a defender algo que hasta hace poco parecía elemental: que una vida humana no puede reducirse a una secuencia de decisiones optimizadas; que la conciencia no es una interfaz; que la responsabilidad no puede delegarse en un sistema diseñado para obedecer objetivos ajenos; y que, incluso en un mundo poblado de dobles sintéticos, y presencias artificiales, seguirá existiendo una diferencia moral insustituible e inherente al ser humano. ~

El autor es fundador de News Sensei, un brief diario con todo lo que necesitas para empezar tu día. Engloba inteligencia geopolítica, trends bursátiles y futurología. ¡Suscríbete gratis aquí!